Jpegli, un Jpeg plus efficace signé Google

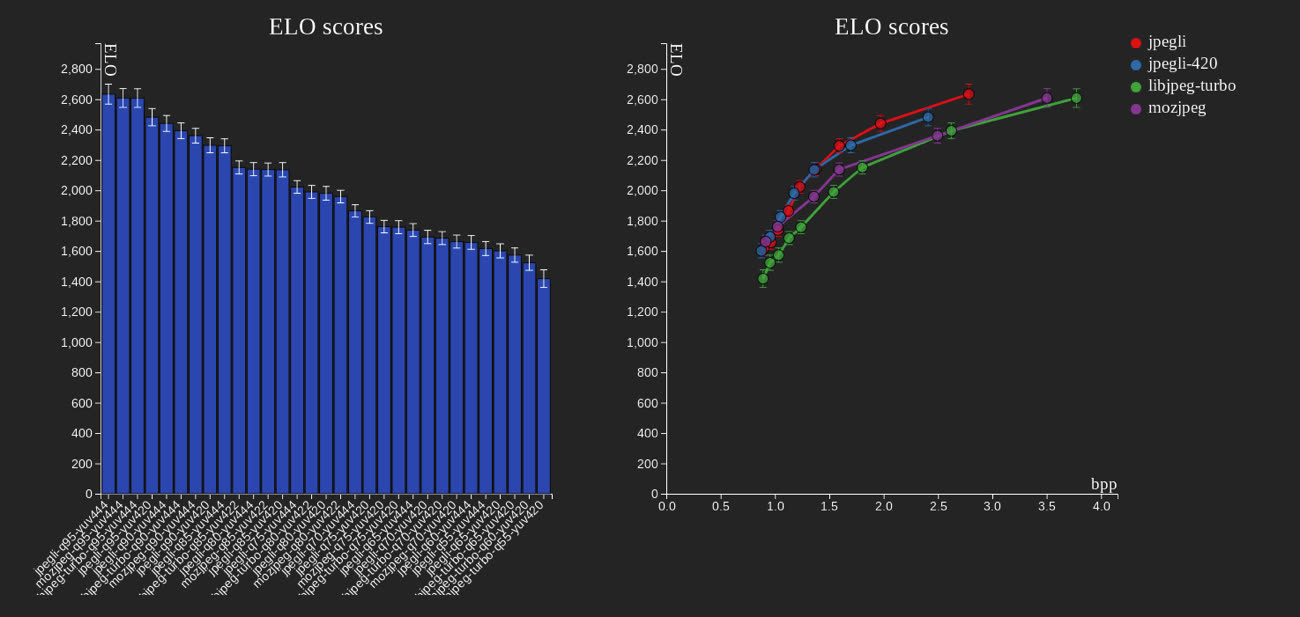

Google a récemment présenté Jpegli, une nouvelle bibliothèque de codage JPEG qui va compresser les images 35 % plus efficacement qu’avec les codecs traditionnels. Ses créateurs expliquent que la technologie conserve une excellente qualité d’image : la compatibilité avec le JPEG existant est maintenue, et on nous promet un rendu plus joli avec moins d’artefacts.

Google donne différents détails sur son billet de blog dédié à la nouveauté. L’entreprise explique que la vitesse de Jpegli est comparable aux approches traditionnelles, telles que libjpeg-turbo et MozJPEG : les développeurs pourront donc l’intégrer plus facilement sans craindre des soucis de performances. Jpegli peut être encodé avec plus de 10 bits par composant, ce qui est une progression par rapport au JPEG habituel. Elle permet d’utiliser des espaces de couleur plus complexes.

La nouveauté utilise plusieurs techniques de pointe pour réduire le bruit tout en améliorant la qualité de l’image. Elle se base entre autres sur la quantification adaptative et sur une sélection améliorée de la matrice de quantification. Les sources ont été mises en ligne sur GitHub pour les curieux. Google estime que ce système va permettre d’économiser de la bande passante, de l’espace sur les serveurs tout en offrant un chargement des pages plus rapide.

@jeffbond31179

Il ne s’agit pas tout à fait de la même chose ici, mais découverte sympa

@jeffbond31179

Jpeg mini donne des résultats très aléatoires et souvent mal calibrés selon mon expérience. Soit aucun gain soit une compression trop visible.

ha un nouveau successeur à jpeg ? intéressant, je le rajoute à ma collection sur ma cheminée.

correction! ce n'est pas un nouveau format mais une optimisation et ajout au standard jpeg. je remplace donc mon commentaire. Mais mon aigreur perdure ! :)

sur ce je vous laisse j'ai des GIF (avec un g doux, bande de malades) à partager sur les réseaux asociaux.

@oomu

"sur ce je vous laisse j'ai des GIF (avec un g doux, bande de malades)"

Je sursaute toujours quand j'entends qq'un parler de "guiga" octets...

“Google estime que ce système va permettre d’économiser de la bande passante, de l’espace sur les serveurs tout en offrant un chargement des pages plus rapide.”

Petite astuce pour M. Google : un bloqueur de pubs est bien plus efficace sur ces trois critères !

De rien.

Performance, performance...

lors de la compression ou de la décompression ? 😳

C'est un petit détail non négligeable, non ?

Car dans un cas ce sont les créateurs qui sont le plus concernés, dans l'autre c'est nous tous, tous ceux qui devront visionner des images avec ce nouveau format.

La décompression, c'est vraiment pas un problème. D'abord parce que le JPEG, c'est assez basique (on décompressait du JPEG sur des 68000, lentement, mais on le faisait) et ensuite parce qu'il y a une accélération du décodage dans les GPU depuis un moment maintenant.

La compression, dans un sens, con s'en moque : c'est fait une fois et c'est fini.

Mouais: l’interêt du jpeg est son acceleration materiel qui libère le proc et est très efficace énergitiquement parlant.

Ils sont bien gentils chez Google mais si c’est pour avoir un encodage/decodage par software, l’intérêt est minime.

Pour améliorer le chargement des pages, il y a bien plus efficace que cette variante de codec : un bloqueur de trackers.

Pages