Apple Intelligence n’échappera pas à un problème qui touche toutes les IA génératives : le système risque d’« halluciner », c’est-à-dire d’inventer un fait et de présenter celui-ci comme vrai. C’est ce qu’a reconnu Tim Cook dans une interview accordée au Washington Post :

- À quel point êtes-vous convaincu par le fait qu’Apple Intelligence n’hallucinera pas ?

- Pas à 100 %. Mais je pense que nous avons fait le maximum, y compris réfléchir très sérieusement à l’état de préparation de la technologie dans les domaines où nous l'utilisons. Je suis donc convaincu qu’elle sera de très haute qualité. Mais je dirais en toute honnêteté que ce n'est pas à 100 %. Je ne prétendrais jamais que c'est à 100 %.

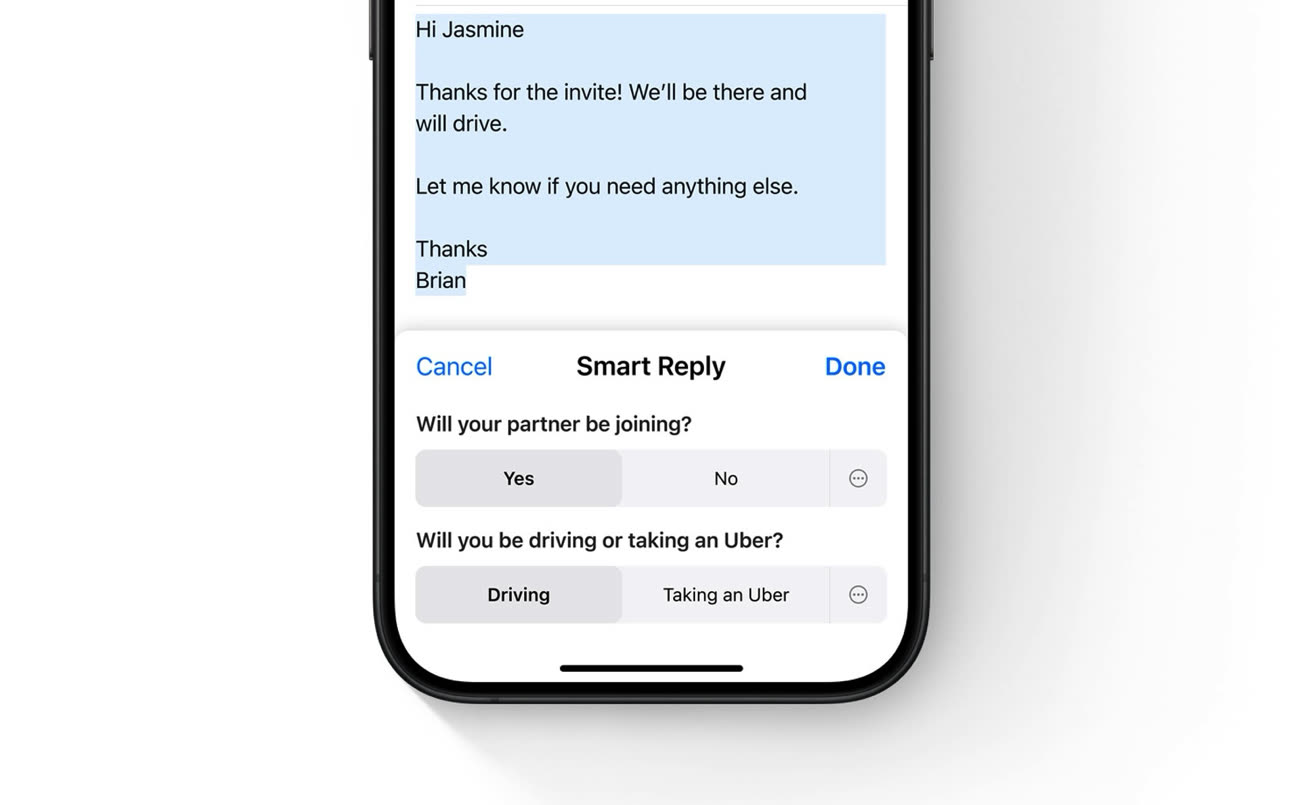

Intégré ultérieurement à iOS 18 et macOS Sequoia sur les terminaux compatibles, Apple Intelligence permettra entre autres de générer des réponses toutes faites à des emails, résumer des textes et créer des images. Avant d’exploiter ou de partager ces contenus sortis du cerveau d’Apple, il vaudra donc mieux s’assurer de leur exactitude. Ce serait bête de manger de la colle simplement parce qu’une IA générative le conseille.

Les hallucinations sont un problème fondamental des grands modèles de langage qu’aucun scientifique n’a réussi à résoudre pour le moment — une étude affirme même que le problème est inévitable avec les technologies actuelles.

Mais iOS 18 et macOS Sequoia n’auront pas seulement de la matière grise venant de Cupertino, ils pourront aussi donner la parole à ChatGPT, un service opéré par OpenAI. Apple va mettre en place quelques mesures pour que les utilisateurs sachent à quel service ils s’adressent : si Siri n’est pas capable de répondre à une question, il demandera explicitement s’il peut passer le relai à ChatGPT. La fenêtre de ChatGPT comprendra un petit message conseillant de vérifier les infos importantes.

Alors que des employés d’OpenAI ont récemment publié une lettre ouverte pour mettre en garde contre les dangers des IA génératives, des dangers que le CEO Sam Altman ferait passer au second plan, Tim Cook n’apparait pas gêné par ces remous : « Nous avons tout examiné et tout pris en considération, et nous avons conclu que c’était dans le meilleur intérêt de nos utilisateurs de les choisir. »