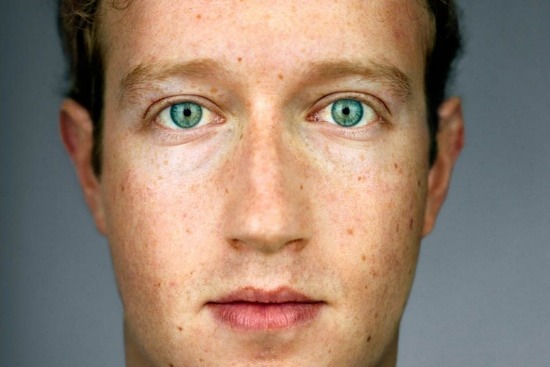

Tout ne serait qu’une histoire de « mauvaise communication » , comme l’a avoué Sheryl Sandberg, la directrice des opérations de Facebook à la presse indienne. Et pourtant, l’affaire des flux manipulés dans le cadre d’une étude scientifique risque bien de se transformer en véritable cauchemar, ternissant un peu plus l’image du réseau social.

En janvier 2012, Facebook a mené une expérimentation pour le compte de chercheurs des universités Cornell (Californie) et de San Francisco. Le réseau social a modifié l’affichage des statuts chez 689 003 utilisateurs choisis au hasard, sans rien leur révéler. Pendant une semaine, leurs flux d’actualité ont affiché des messages soit positifs, soit négatifs. Les scientifiques ont ensuite analysé les messages de ces cobayes afin d’en connaître la teneur émotionnelle.

L’objectif de l’étude était de savoir si l’humeur des utilisateurs de Facebook pouvait être influencée par les émotions exprimées de leurs correspondants. Les enseignements de cette enquête à grande échelle prouvent que oui… dans une certaine mesure : les sentiments sont bien « contagieux » par écran interposé (les utilisateurs bombardés de statuts négatifs postent ensuite des messages plutôt négatifs, et c’est l’inverse pour ceux qui ont reçu des statuts positifs). L’étude reste néanmoins contestée pour sa qualité scientifique, ne serait-ce que sur l’interprétation faite du terme « émotion » par les chercheurs, ou encore par l’environnement de l’utilisateur qui ne se limite pas au seul Facebook et dont l’influence est impossible à quantifier.

Mais au-delà des conclusions de cette enquête, ce sont surtout les conditions de sa réalisation qui font polémique, et le fait que Facebook n’ait prévenu personne de cette étude – et surtout pas les cobayes. La manipulation des flux d’actualités est avérée, ce qui pose de sérieuses questions sur l’influence que peut exercer le réseau social (avec en toile de fond, des accusations sourdes de « Big Brother »). Si Facebook peut disposer à sa guise des informations publiées par ses utilisateurs et organiser les flux d’activités suivant le bon vouloir de ses algorithmes, ce ne sont sans doute pas des raisons pour manipuler ainsi ses abonnés… même si l’on parle ici d’une étude scientifique sans but publicitaire.

Facebook s’est justifié en expliquant réaliser des recherches pour « améliorer » ses services en essayant de « comprendre » la réponse des utilisateurs à des contenus positifs ou négatifs. Adam D. I. Kramer, co-auteur de l’étude, a également minimisé la portée de l’étude en précisant que seuls 0,04% des utilisateurs du réseau social ont été ainsi « surveillés » tout en assurant qu’aucun statut ne leur avait été caché. Depuis 2012, Facebook a révisé ses pratiques en matière de recherches.

Ces explications n’ont pas suffi à calmer les inquiétudes. L’Information Commissioner’s Office britannique, équivalent de la Cnil française, va ainsi ouvrir une enquête et juger si Facebook a enfreint la législation sur le respect des données privées. L’excuse de l’« erreur de communication » avancée par Sheryl Sandberg risque de ne pas suffire.