Plusieurs sites américains et français ont publié leurs premières évaluations des nouvelles cartes graphiques d'AMD, les RX Vega 56 et RX Vega 64 (Hardware.fr, AnandTech, voire TechRadar).

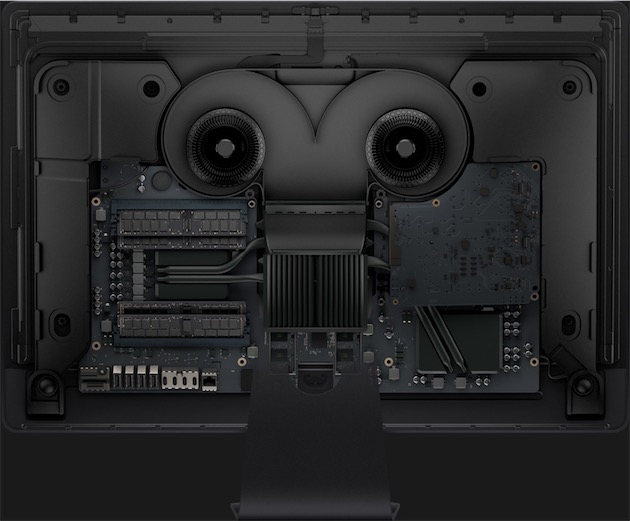

Leur lecture complète assouvira la soif de détails pour tous ceux que ces nouveaux GPU intéressent, pour un Hackintosh mais aussi et surtout parce qu'il vont figurer dans le futur iMac Pro attendu avant la fin de l'année.

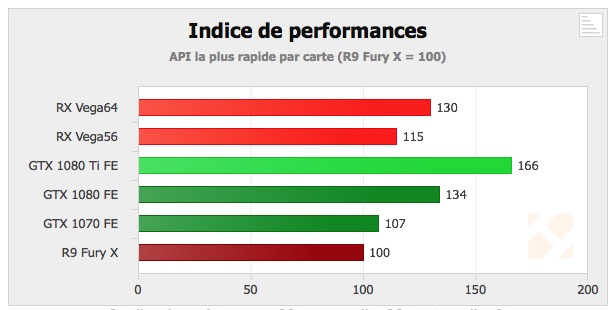

Les conclusions de chacun mettent en exergue la capacité de ces cartes à venir affronter les gros modèles GTX 1070/1080 de Nvidia bien installés dans le paysage. Cependant Nvidia a toujours du répondant et ses solutions restent très pertinentes.

AnandTech décrit des Vega 64 au coude-à-coude avec les GeForce GTX 1080 pour les jeux, dans une définition de 3820x2160. Cependant la GeForce devance parfois nettement sa concurrente.

Surtout, la différence de consommation électrique n'est pas du tout à l'avantage de la nouvelle carte d'AMD. Avec 295 Watts, elle dépasse de 110 à 150 Watts les modèles Nvidia.

Apple va avoir fort à faire pour tempérer ces excès, la ventilation de l'iMac a été revue et cela peut passer aussi par une décélération de la puce graphique utilisée. La fiche technique de cet iMac s'en tient pour l'heure à des informations basiques et parle sommairement de "Radeon Pro Vega 56 et Vega 64".

La Vega 56 montre une consommation plus élevée aussi que sa concurrente la Nvidia GTX 1070 (de 45 à 75 W plus importante) et elle est en moyenne 8 % plus rapide que cette dernière. Comparée à la Vega64, elle offre environ 90 % de ses performances.