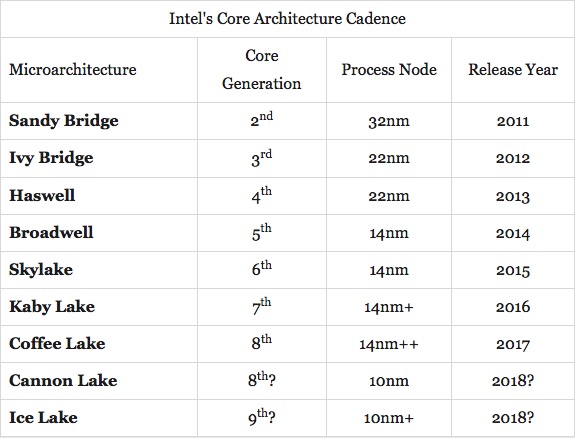

Intel a officiellement annoncé une prochaine architecture processeur baptisée "Ice Lake". Elle est promue comme profitant d'une finesse de gravure de 10 nm, apte à réduire encore la consommation électrique. C'est tout ce que son fabricant en dit pour le moment.

Actuellement les processeurs d'Intel s'en tiennent à 14 nm et le passage vers ce nouveau seuil reste délicat. Ars Technica, qui a repéré l'apparition soudaine de cette nouvelle référence, s'en étonne puisque le fondeur a déjà sur le feu Coffee Lake (successeur des Kaby Lake qui équipent les derniers Mac) et Cannon Lake, deux évolutions à propos desquelles les détails sont là aussi ténus.

La lecture de la grille des prochaines architectures d'Intel s'en trouve dès lors compliquée. Ice Lake est sommairement présenté comme le successeur, en 10 nm, de Coffee Lake alors que ce rôle était jusque là dévolu à Cannon Lake.

Telles que les choses se présentent, les ordinateurs de bureau et les portables utiliseraient Coffee Lake, les portables seuls (et machines de bureau, comme l'iMac qui peuvent utiliser des puces pour portables) passeraient ensuite sur Cannon Lake et tireraient avantage les premiers de cette nouvelle finesse de gravure. Puis, tout le monde embarquerait sur Ice Lake.

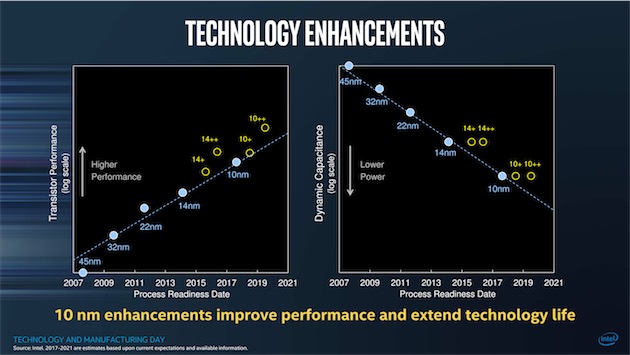

Pour Ars Technica Intel pourrait vouloir roder et mûrir ses techniques de fabrication en 10 nm sur les puces pour portables, car plus petites — les taux d'échec sont moins graves eu égard aux volumes produits - avant d'en faire bénéficier les plus gros processeurs pour machines de bureau.