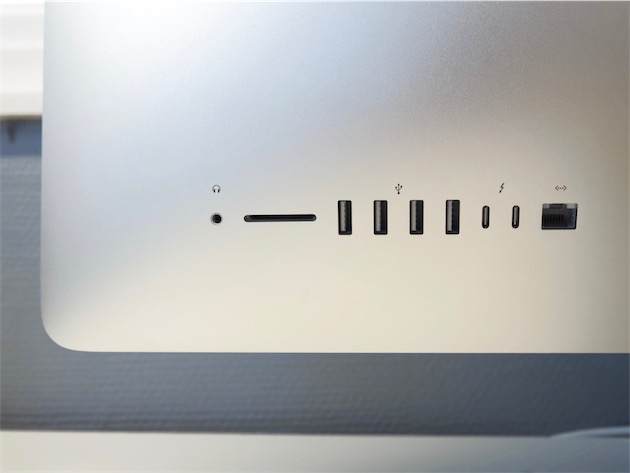

Les iMac Retina 4K et 5K 2017 ne prennent pas en charge le mode « d’affichage cible ». Ce n’est pas une surprise : cette fonction, qui permet d’utiliser l’écran du tout-en-un comme l’écran externe d’un autre Mac ou par exemple d’une console de jeux, a disparu avec le passage au Retina. Mais il se dit qu’elle pourrait bien ne jamais revenir.

Nous évoquions, dans notre test de l’iMac Retina 5K 2017, une lacune de la norme Thunderbolt 3, qui comprend DisplayPort 1.2 (suffisante pour les écrans 4K et les écrans 5K à deux demi-dalles) mais pas DisplayPort 1.3 (nécessaire pour les écrans 5K à dalle unique). L’adoption du Thunderbolt à la mi-2011 avait déjà compliqué le fonctionnement du mode d’affichage cible, inauguré par l’iMac 27 pouces fin 2009.

Apple pourrait tenter de surmonter cet écueil technique… mais ne semble pas en avoir la moindre envie. Selon un représentant d’Apple cité par AppleInsider, en effet, « il n’est pas prévu que cette fonction réapparaisse » dans de futurs modèles. Voilà qui a le mérite d’être clair.