Raycast, un lanceur multitâches pour le Mac et maintenant l’iPhone, n’a pas loupé le train de l’IA. Bien au contraire, c’est désormais une fonctionnalité majeure de l’app, qui propose d’accéder facilement à de nombreux modèles, jusque-là tous en ligne. Ces intelligences artificielles génératives sont toutes payantes, ce qui explique aussi que cette fonction est réservée aux abonnés « Pro », qui demande une centaine d’euros par an. Néanmoins, si vous ne voulez pas payer, ou alors que dépendre d’un serveur distant pour ces tâches ne vous enchante guère, la dernière version de Raycast apporte une réponse intéressante.

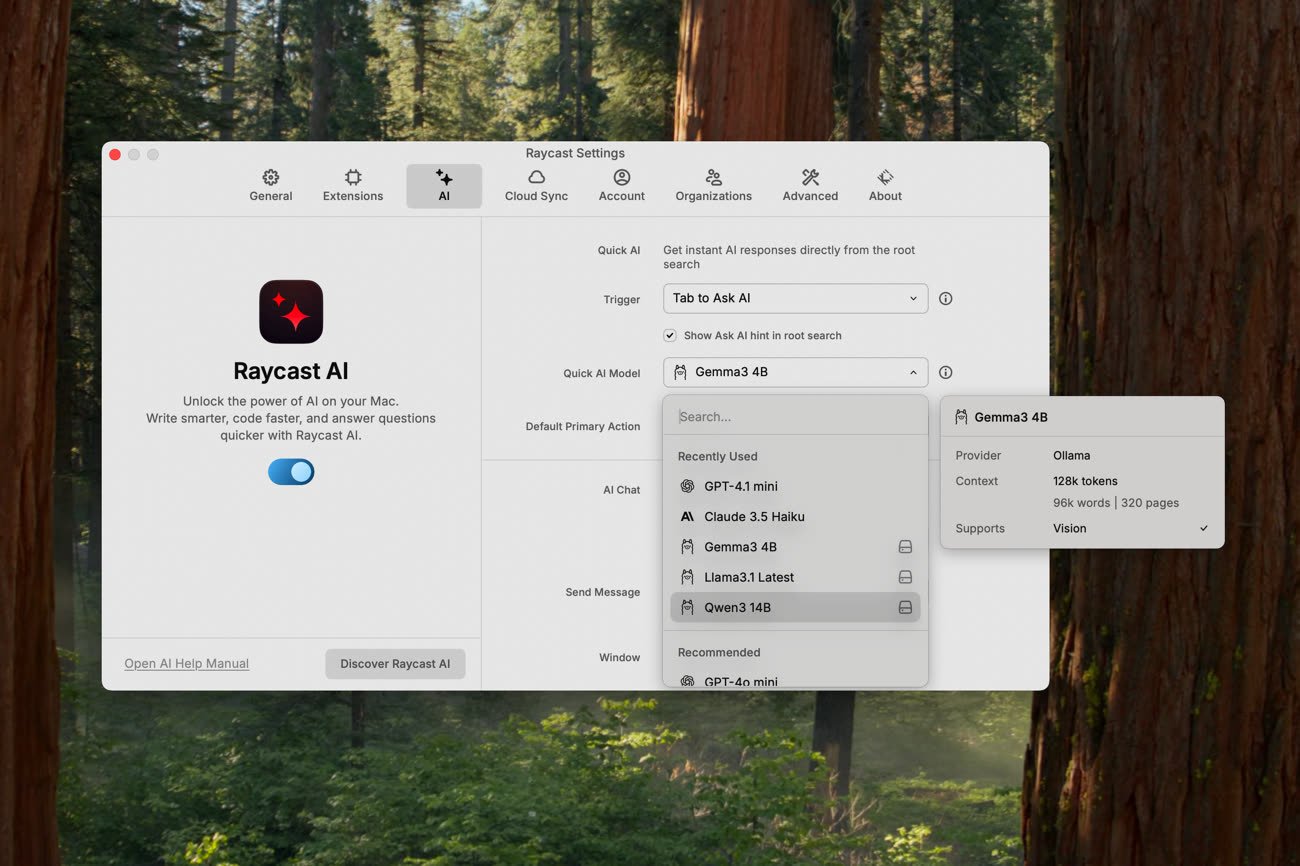

La version 1.99 qui est désormais disponible ajoute en effet la possibilité d’utiliser un grand modèle de langage exécuté en local. Cette capacité repose sur Ollama, qui est certainement la solution la plus populaire pour télécharger et exécuter une IA générative sur son ordinateur. Tous les modèles proposés par Ollama sont compatibles avec Raycast, même s’il faudra prendre soin d’en choisir un qui soit adapté à ses besoins et surtout à la puissance de son ordinateur. Certains modèles sont aussi équipés pour la vision, c’est-à-dire la possibilité d’analyser une image, ce qui est utile pour exploiter toutes les fonctionnalités du lanceur. D’autres sont plus adaptés pour les outils, ce qui sert pour les extensions AI de l’app.

Sur mon Mac Studio de 2021, le modèle de base avec une puce M1 Max et 32 Go de mémoire vive, j’ai obtenu de bons résultats avec le Gemma3:4b. Ce modèle basé sur Gemini de Google s’exécute suffisamment rapidement pour que ce soit viable et demande autour de 4 Go de mémoire vive, ce qui me permet d’éviter la saturation avec les autres apps et le système. La version 12B serait sans doute plus fiable et plus compétente, même si la vitesse d’exécution est vite un point bloquant.

Quoi qu’il en soit, c’est une excellente option pour tester les IA intégrées à Raycast, surtout si vous avez un Mac suffisamment puissant. Aucun abonnement n’est nécessaire si on se limite aux modèles en local, ce qui est appréciable. En revanche, on ne peut toujours pas utiliser son propre compte OpenAI ou bien une clé d’API fournie par un autre fournisseur, il faut toujours payer Raycast Pro pour utiliser les modèles en ligne.