Si Apple reste bien discrète dans la grande course à l’IA qui secoue toute l’industrie depuis 1 an, Cupertino continue d’affuter ses armes. Sans tambour ni trompette, l’entreprise a mis en ligne un nouveau modèle de langage baptisé Ferret au mois d’octobre. Celui-ci a pour particularité d’être multimodal, et donc de mélanger textes et images.

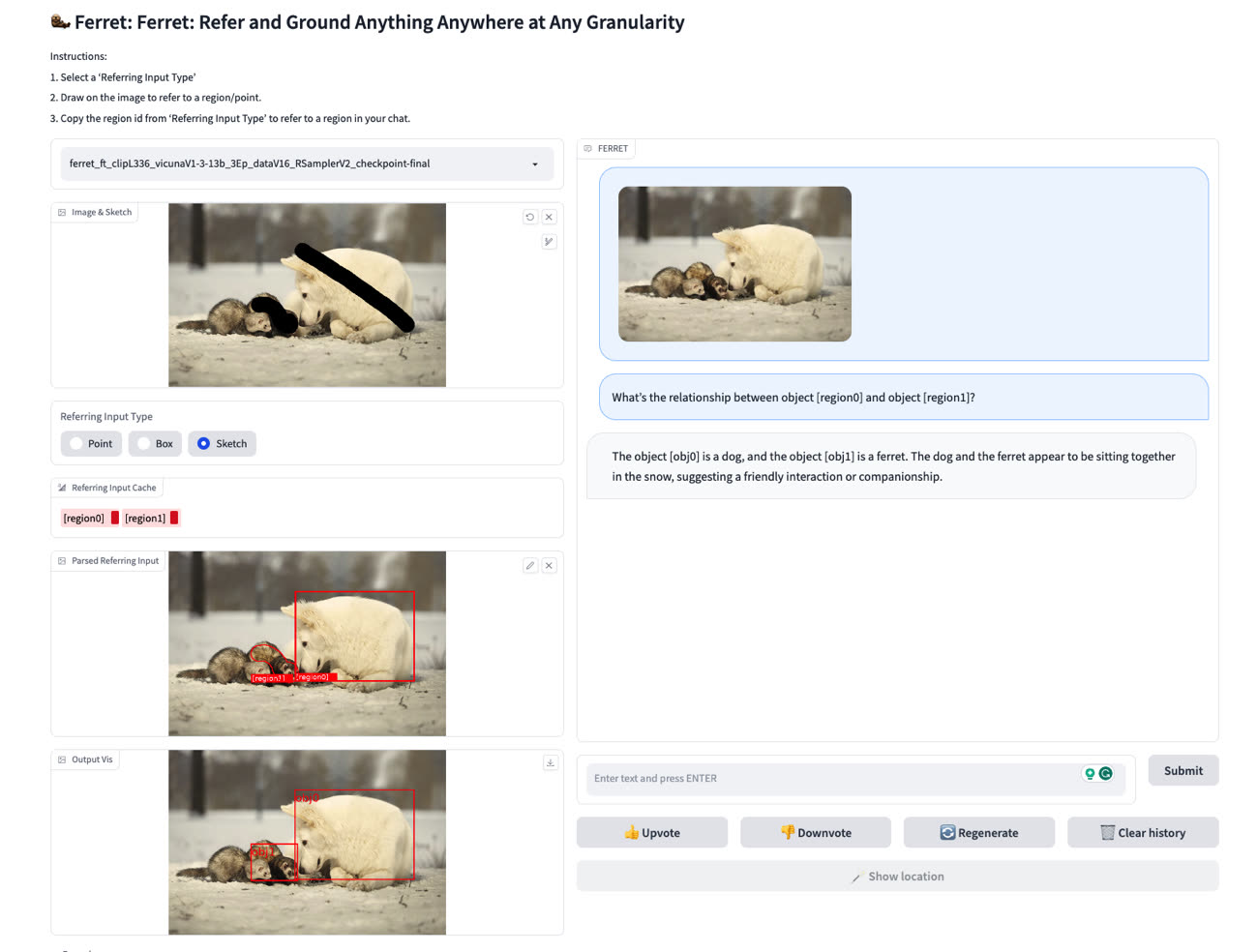

Ce modèle peut déterminer les éléments composant une image, les délimiter et les identifier pour qu’ils puissent être utilisés dans une requête. Plusieurs utilisations sont possibles : l’utilisateur pourra par exemple mettre en valeur un animal sur une image, et Ferret lui indiquera de quelle espèce il s’agit. Il a la capacité de séparer un élément du reste d’un groupe, et de préciser le contexte d’une photo.

Le chercheur d’Apple Zhe Gan affirme que le modèle « montre souvent une meilleure compréhension précise des petites régions de l'image » que GPT-4V, le modèle spécialisé d’OpenAI. Deux versions ont été publiées, une avec 7 milliards de paramètres et une seconde avec 13 milliards. Apple indique que son modèle a été entraîné sur 8 GPU NVDIA A100 avec 80 Go de mémoire. Ferret est open source, même si sa mise à disposition se fait sous licence non commerciale (il ne peut pas être commercialisé en l’état).

Ce type de technologie pourrait sans problème trouver son utilité au sein de l’app Photos d’Apple en améliorant la recherche d’images. Elle pourrait également servir à un éventuel AppleGPT, qui serait en développement à Cupertino selon les rumeurs. Aux dernières nouvelles, Apple aurait prévu de mettre le paquet sur l’intelligence artificielle dans ses prochains systèmes d’exploitation et dépenserait sans compter pour percer dans le domaine.

iOS 18, Siri, iWork : Apple se prépare à ajouter de l'IA dans tout son écosystème

La Pomme a récemment publié deux travaux de recherche liés à l’IA. Le premier concerne une technique permettant d’utiliser la mémoire flash d’un appareil pour faire tourner un large modèle de langage (LLM), tandis que le second est utilisé pour créer un avatar 3D à partir de quelques secondes de vidéo d’un individu en mouvement. Apple expérimente également avec les outils de génération d’images dans le style de DALL-E ou de Midjourney.

Source :