macOS Sonoma/iOS 17 : ces fonctions pas encore prêtes pour le français

Cinq nouvelles fonctions des prochains systèmes d'Apple ne seront pas proposées aux utilisateurs français. En cause, leur usage de la langue qui les réserve à l'anglais pour une durée indéterminée.

La plupart de ces nouveautés sont communes à iOS et iPadOS 17 ainsi qu'avec macOS Sonoma. Apple ne donne aucune indication à ce stade d'une compatibilité à venir pour d'autres langues.

iOS 17 : ces nouvelles fonctions qui ne seront pas compatibles avec tous les appareils

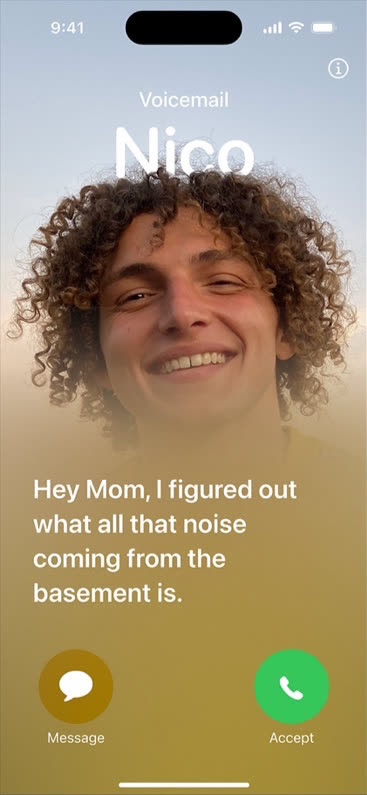

Live Voicemail

Dommage, cette fonction semble bien pratique. Il s'agit d'une transcription textuelle, en direct, du message vocal qu'un interlocuteur est en train de vous laisser. Vous pouvez voir immédiatement s'il est nécessaire de prendre la communication ou si cela peut attendre.

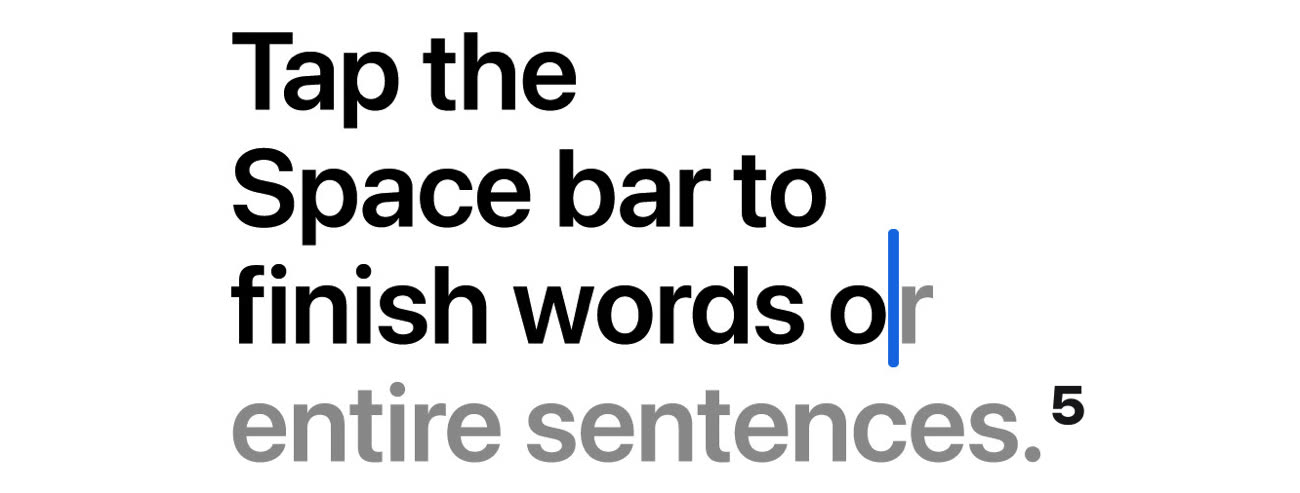

Clavier : prédiction de la frappe en ligne

Au moment de la frappe, iOS ne va pas se contenter de proposer des mots dans la rangée au-dessus du clavier, il va directement compléter la fin de votre phrase.

Cette proposition sera affichée en gris et, si d'un coup d'œil vous considérez qu'elle est appropriée, un tap sur le bouton d'espacement la validera. Cette fonction a besoin d'un iPhone 12 au moins. Une remarque toutefois, nous avons vu plusieurs fois cette fonction apparaître en français et en espagnol dans la première bêta. Mais cela restait assez bugué.

"Siri" et rien que "Siri"

Seuls les utilisateurs des principaux pays anglophones pourront appeler l'assistant d'Apple par "Siri" en laissant tomber le "Hey". Nous autres devrons continuer avec le "Dis, Siri".

Ce sera possible avec n'importe quel iPhone ou iPad compatible avec le futur système, mais sur Mac il faudra une puce Apple Silicon. Et pour les écouteurs, on devra avoir des AirPods Pro 2. Ce sont les seuls à ce jour à utiliser la puce H2. Les autres, AirPods Max compris, ont une H1.

Siri : requêtes multiples

Lorsque Siri écoute votre requête, vous pouvez en formuler plusieurs autres sans répéter le nom de l'assistant. Apple n'a pas précisé combien de commandes pouvaient être enchainées ainsi.

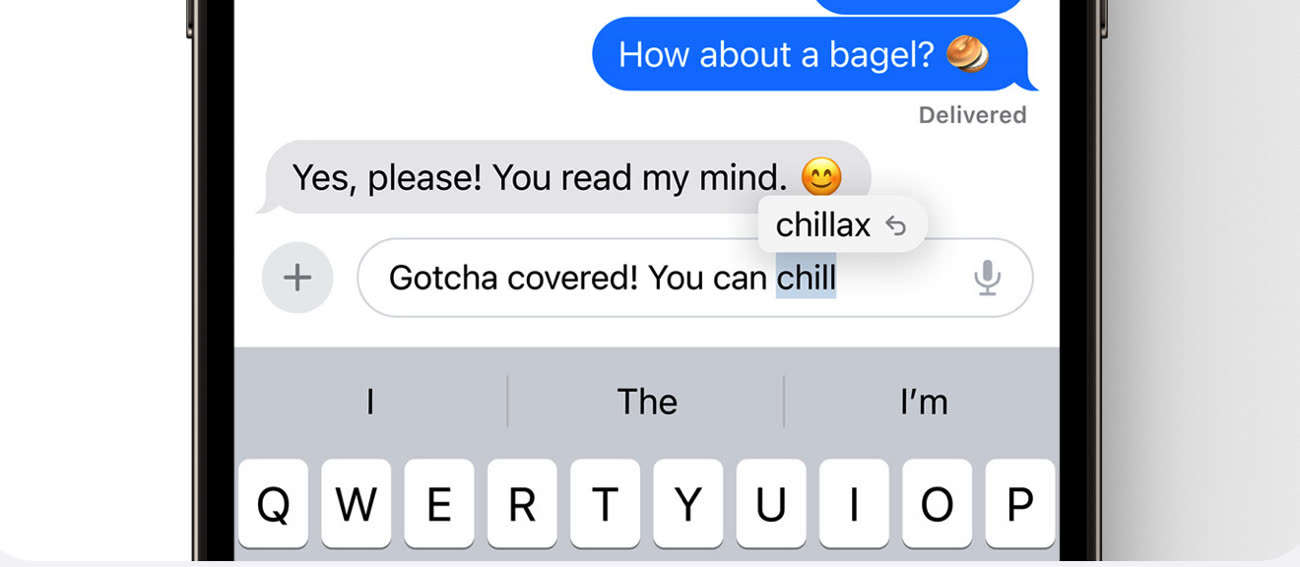

Clavier : autocorrection

La fonction est décrite comme compatible avec plusieurs langues, dont le français. Mais il conviendra de voir si cela inclut la Suisse et la Belgique ou s'il y a une distinction chez Apple, comme cela arrive parfois.

Au fil de votre frappe, le système corrige automatiquement les mots erronés sans intervention de votre part. Ils sont brièvement surlignés pour que l'on sache ce qui a été modifié. D'un tap on peut forcer le mot d'origine à reprendre sa place. Il faudra avoir un iPhone 12 au moins pour que cette fonction marche dans notre langue.

Autant certaines je peux comprendre, autant « Siri »… j’ai du mal à voir ce qui bloque plus en français qu’en anglais.

@gvarlet

Laissez tomber Apple de temps en temps fait du Apple ça m’énerve aussi cette façon de faire 👿

@gvarlet

Il faut étudier toutes les interactions avec le langage pour bien affiner la détection du « Siri » et ne pas déclencher sur un « chérie » , « scierie », « Syrie »,…

@Sgt. Pepper

"aciérie" aussi 😂

Un iPhone 12 pour de la simple correction, c’est la que je déteste Apple 👿

Comme d'habitude, s'il existe une réelle raison technique la moindre des choses serait qu'ils l'expliquent.

@lll

Entièrement d’accord 👍😈

@lll

Explications que personne n’ira lire.

Même quand les personnes concernées chez Apple sont questionnées sur les raisons techniques de leurs choix et qu’ils expliquent pourquoi il faut tel appareil minimum, tout les ingénieurs ici vont dire que c’est faux parce que c’est bien connu qu’ils savent mieux. Alors à quoi bon ?

@R-APPLE-R

C’est un des rares trucs compréhensifs.

Si je ne me trompe pas le Neural Engine de l’A14 a fait un grand pas en avant par rapport à l’A13. Ça doit sûrement expliquer la limitation à l’A14 minimum.

@florian3104

Oui enfin des claviers tiers ou ceux de Google le font donc pour moi c’est juste de l’obsolescence programmée 👿

8 coeurs neural engine ne suffisent pas pour cela, il en faut 16 a minima, afin de pouvoir calculer et predire en temps reel le mot suivant. c'est hyper complexe.

heureusement que les puces des telephones android ont toujours ete, historiquement, 100 fois plus puissantes et developpees que celles d'apple. ca explique pourquoi l'auto correction et les suggestions de textes sont aussi bonnes sur android depuis 10 ans lol

@ratz

C’est ça qui m’énerve chez Apple ce côté pingre alors que l’ont payent plus cher le produit en plus 👿

C'est pour que tu payes encore plus , sont pas cons chez apple

@R-APPLE-R

Non c’est juste votre radinerie qui ressort

@corben64

C’est juste votre débilité qui parle 😈

@ratz

"les puces des telephones android ont toujours ete, historiquement, 100 fois plus puissantes et developpees que celles d'apple."

Source : tkt

Et non, sur Android quant bien même si cette fonction existerait depuis 10 ans, elle n'a pas été comme celle d'iOS 17. C'est de l'autoprédiction basique comme sur les précédentes versions d'iOS.

tkt.com, la source la plus fiable du net !

il ya de l'autopreditction de phrase dans plusieurs applications (gmail par exemple)mais c'est vrai que je ne sais pas si ca marche depuis le clavier uniquement

par contre il me semble que la correction basee sur le contexte est deja presente avec gboard. comme ios17

qu'y a t il d'autre de special sinon ?

😂 les seuls nouveautés intéressantes quoi! Donc je vais pas installer iOS 17 tout de suite.

ptn, toutes les bonnes nouveautes en fait lol

marrant que "siri" soit limite aux airpods pro 2 . enfin marrant n'est pas le mot . vu que ca ne necessite pas de puce h2

« Siri », au lieu de « Dis, Siri » fonctionne bien sur mon iPhone et ma Béta IOS17.

questions pour les anglophones(ou les bilingues, peu importe en fait ), je suis tente de mettre mon ipad en anglais, comme je lai fait sur mon telephone samsung ...mais:

comment vous gerez l'auto correction ? avec gboard c'est simple, google est assez intelligent pour corriger et gerer deux langues a la foi. cpdt de mon souvenir , apple sont bcp trop cons pour cela, et on est oblige de faire une magouille dans les languages systemes , et ca marche de maniere erratique, pour ne pas dire bordelique. avez vous trouver comment palier ce probleme ? faudrait vraiment quils ajoutent une option multilangue a leur clavier

est ce que le live voicemail va essayer de transcrire en anglais..alors que les gens parlent en francais ?

siri est il capable de comprendre un message francais ? je m'explique :

je veux envoyer un message a ma mere, je dis "hey siri, send a message to maman" , puis enchaine avec "j'arrive dans 30 minutes environ" . est il capable de faire ca ?

Je suis bilingue anglais-francais.

Pour la frappe clavier ça fait un moment déjà que j’ai plus trop de soucis. J’ai mis les deux langues accessibles, mais iOS suit globalement la langue dans laquelle j’écrit même sans changer la langue du clavier hormis quelques rares cas.

Pour Siri, je devrais refaire le test mais j’ai arrêté de m’en servir hors lecture Apple Music car justement il ne permet pas de dicter dans les deux langues, uniquement celle configurée.

comment avez vous mis les 2 langues accessible? je ne suis pas sur de comprendre

oh et au fait, sur macOS, vous faites comment?

merci pour safari !

J’ai mon iOS en anglais, après dans les réglages du clavier j’ai rajouté le français. Depuis quelques années iOS arrive à détecter la langue sans avoir à manuellement choisir la langue du clavier. Par exemple je viens de rédiger ce message alors que le clavier est réglé sur anglais. Ça n’a pas toujours aussi bien marché, mais maintenant c’est impeccable.

Siri est par contre toujours bloqué à une seule langue.

top . et le regle par exemple , vous n'avez pas tape les accents? et ca a corrige automatiquement apres l'espace, ou vous avez du cliquer sur le mot propose au dessus du clavier ?

@ratz

Normalement le clavier d’iOS depuis un moment c’est gérer plusieurs langues non?

ben j'avais du mal justement, il y a 6 mois de cela

@ratz

La je lis les commentaires et deux personnes signalent que ça fonctionne bien

@macbook60

Top ! Merci bcp

@ratz

De rien

@ratz

Des années que ça fonctionne.

Je tape en QWERTY la phrase du dessus et il a compris sans souci.

So, you may consider it works as expected.

« Pendant que l'appelant enregistre son message vocal, iOS le transcrit à l'écran. »

Je ne comprends pas comment cela fonctionne, 🤔

Comme l’appelant enregistre son message sur la boîte vocale du répondeur de mon Opérateur …

Je vois pas comment l’iPhone pourrait retranscrire le message en Live ?!

@Sgt. Pepper

Si on a la « messagerie visuelle » (dispo depuis le premier iPhone) activée, je ne sais pas si les messages passent par l’opérateur. Justement il y a 10/15 ans c’était déployé opérateur par opérateur, le temps que tout soit compatible.

@Furious Angel

Avec MVV , les messages sont enregistrés par l’opérateur , non?

La MMV permet juste d’aller lire le message depuis l’App Apple sans faire un appel à la boîte vocale .

Donc je vois toujours pas comment l’iPhone va faire , il va recevoir le message en directe ?

Donc cela va nécessiter un upgrade par l’opérateur ?

@Sgt. Pepper

Je sais pas comment ça fonctionne, mais en tout cas Apple n’a pas fonctionné de compatibilité avec certains opérateurs (ce qui m’a d’ailleurs surpris) donc je suppose que le message arrivé directement sur l’iPhone (mais je suppose totalement)

Je pense qu’il s’agit des messages vocaux enregistrés dans l’app Messages et non pas sur le répondeur ?

non ca c'est autre chose encore

Ça doit être un principe similaire à ce que fait Google depuis quelques années sur les pixel mais fait dire que Google va encore plus loin.

Donc la fonction pour dire juste « Siri » ne va pas être possible sur les HomePods et HomePods mini

Y avait que ça de nouveau et d’intéressant donc ….🥸

En fait pour les français, iOS 17 c’est iOS 16 au summum de sa maturité

L’envoi de sms sans un « échec » n’est pas prêt non plus.

Ces fonction devraient arriver en français lors de la version finale d’iOS 17, il est courant que cela soit limité à certaine langue en beta avant de se généraliser avant la sortie finale.

Pour l’auto-correcteur qui nécessite un A14 minimum, cela pourrait s’expliquer par une meilleure efficience du NE comparé à l’A13 qui permet de moins consommer de batterie. Cela c’est déjà vu avec certaine fonction sur les Mac Mx, un core i7 ou i9 des précédents MacBook aurait peut être aussi pu les faire tourner mais au prix d’une autonomie dégradé ou d’une chauffe accrue ce que Apple as voulu éviter.

concernant intel et AS, la difference reside dans le NPU (je ne sais plus si intel a un TPU/NPU , mais celui d'apple est meuilleur, et il ya une vraie vertical integration)

par contre la on parle de 2 puces apple . certes l'a14 a 2 fois plus de coeurs NPU, et est plus efficiente (comment dit on en francais) , mais je pense surtout qu'on cherche a leur trouver des excuses plus qu'autre chose. a mon avis ils ont pas voulu se prendre la tete et pousser les gens a passer a un modele superieur

ptdr donc on est privés de toutes les nouveautés intéressantes, OK vu 💀

J’ai toujours été surpris que vous n’insistiez pas sur l’absence de Voicemail transcription en français alors qu’elle est disponible depuis iOS 10 (!!) en anglais…

Ça serait tellement pratique.

J’espère que cela sera disponible avec cette nouvelle itération de cette fonction.

Une telle multinationale pas foutue de proposer ces fonctions dans au moins 5 langues de base !!

Alors que Google le fait depuis des années pour pleins de langues, Apple est un peu lent des fois