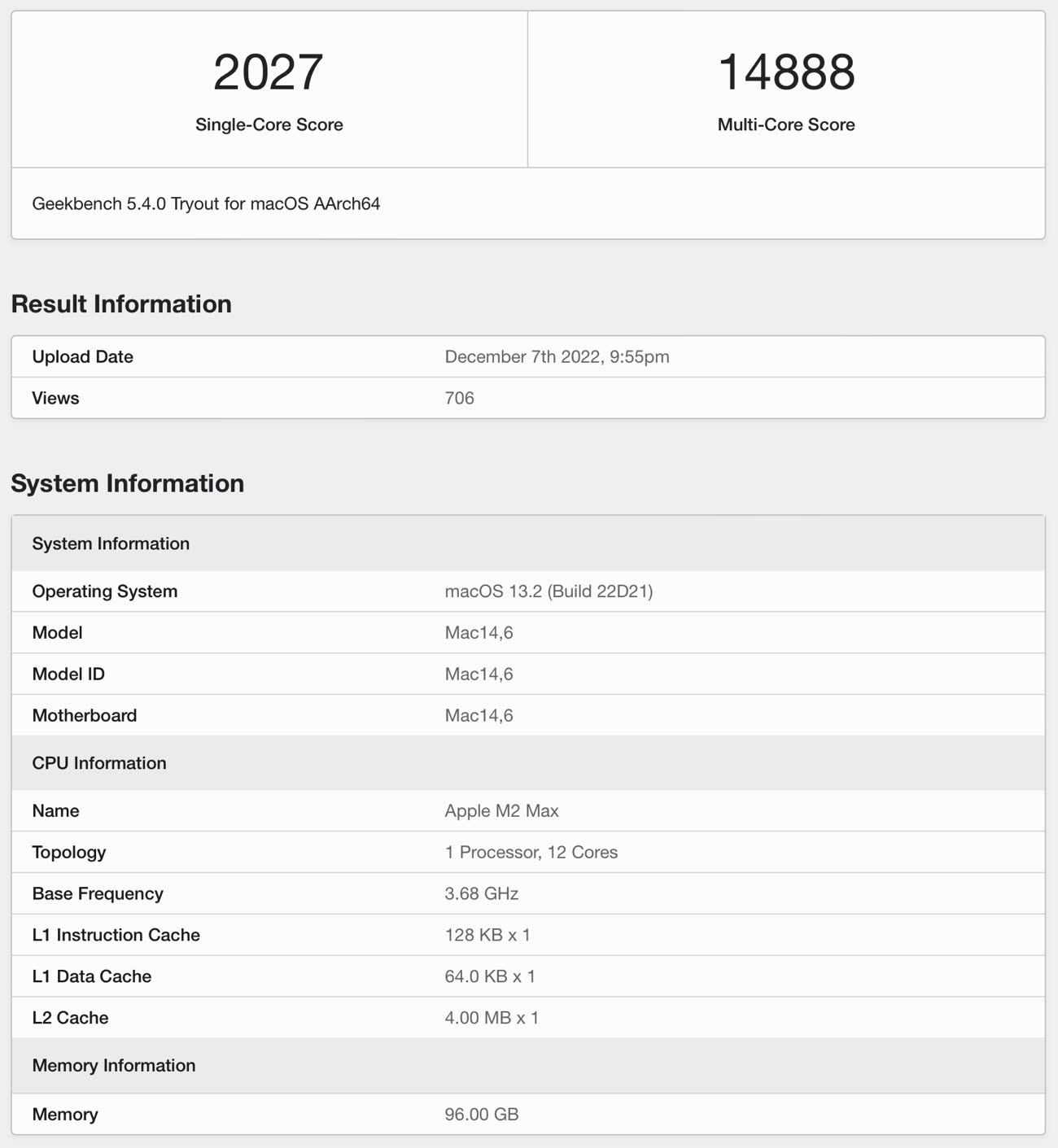

Après un premier résultat d'un Apple M2 Max sur Geekbench fin novembre, un second vient de tomber sur le site du célèbre logiciel de benchmark. Et les chiffres sont un peu plus élevés.

Un premier test d'un Apple M2 Max présumé nous apprend plusieurs choses intéressantes

Les informations sont très similaires : un Apple M2 Max sur un Mac inconnu (Mac14,6) qui pourrait autant être un MacBook Pro qu'un Mac Studio. La machine dispose de 96 Go de RAM et le processeur possède 12 cœurs, comme pour le premier. Nous l'expliquions pour le premier résultat posté, les résultats montrent qu'il s'agit probablement d'une puce en 8+4 (8 cœurs rapides, 4 cœurs basse consommation), alors que le M1 Max est en 8+2.

Le résultat en single core dépasse la barre des 2 000 points et le multi-core est de 14 888. Ce second M2 Max fonctionne à une fréquence un peu plus élevée que le premier (3,68 GHz contre 3,54 GHz) mais la différence de performances est plus grande que le gain en fréquence, ce qui implique des optimisations du côté d'Apple1. Sur un seul cœur, ce M2 Max est environ 15 % plus rapide que la moyenne des Mac Studio sur Geekbench (à peu près 20 % sur tous les cœurs). Le score est aussi assez proche d'un Mac Pro 2019 doté d'un Intel Xeon à 16 cœurs (et 32 threads).

Rappelons qu'un gain réel de 15 à 20 % est considéré comme un résultat correct lors d'un saut d'architecture tel que celui effectué entre le M1 et le M2. Les gains plus élevés ne sont généralement obtenus qu'en partant sur une nouvelle architecture, en augmentant fortement les fréquences ou en lâchant la bride sur la consommation et le nombre de cœurs, ce qui ne semble pas être le cas ici.

-

Ou, plus pragmatiquement que le test a été fait à un moment où le Mac travaillait. Lancer un benchmark peu de temps après une installation peut donner des résultats biaisés, liés aux différentes indexations effectuées par les logiciels Apple. ↩︎