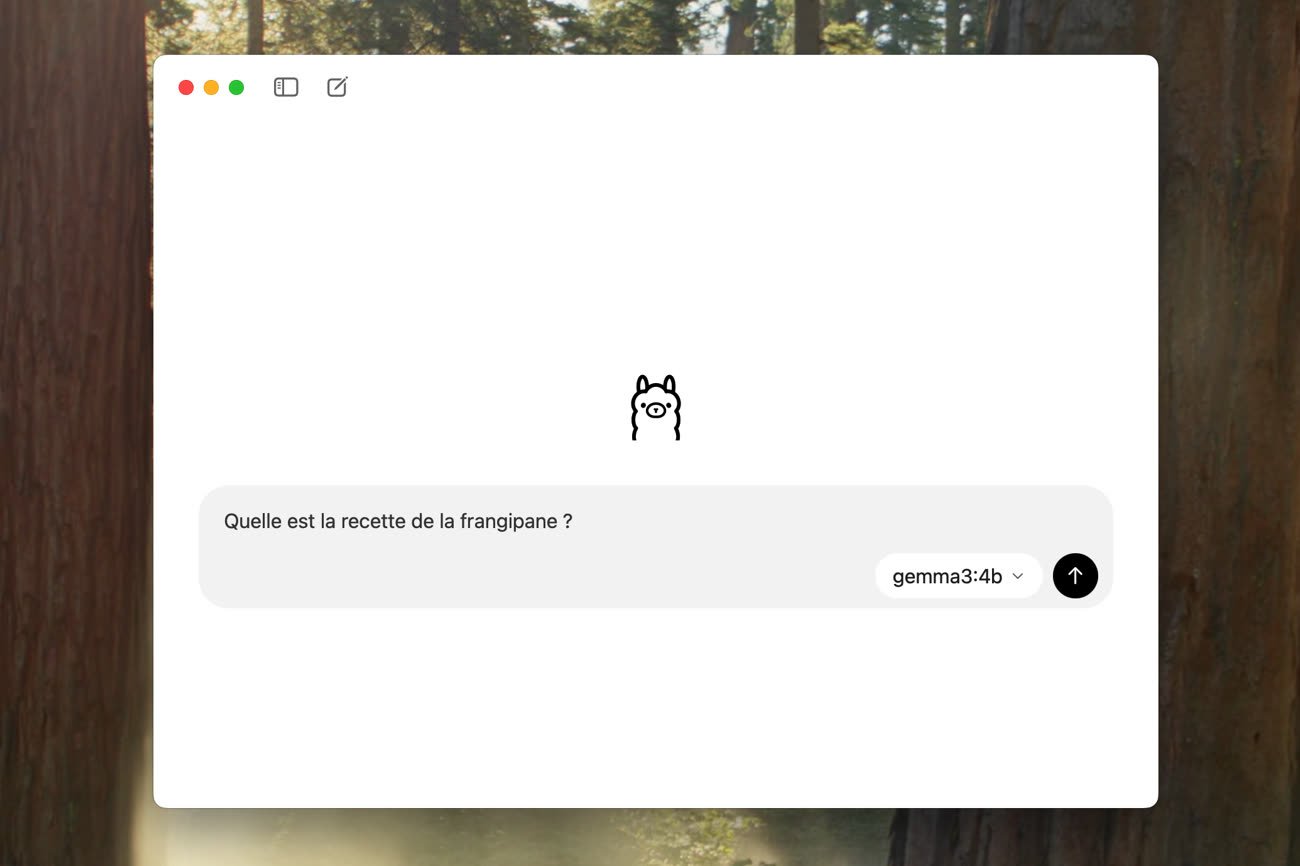

Ollama a commencé uniquement comme un outil à manipuler dans le terminal et si c’est toujours possible de télécharger puis d’interroger des grands modèles de langage par ce biais, ses concepteurs proposent désormais une app avec une interface graphique complète pour se passer des lignes des commandes. L’app existait déjà pour télécharger les modèles, mais le terminal restait jusque-là obligatoire pour interroger une intelligence artificielle générative. Ce n’est plus le cas, l’app Ollama propose une interface graphique très conventionnelle pour créer autant d’échanges que désiré avec l’IA.

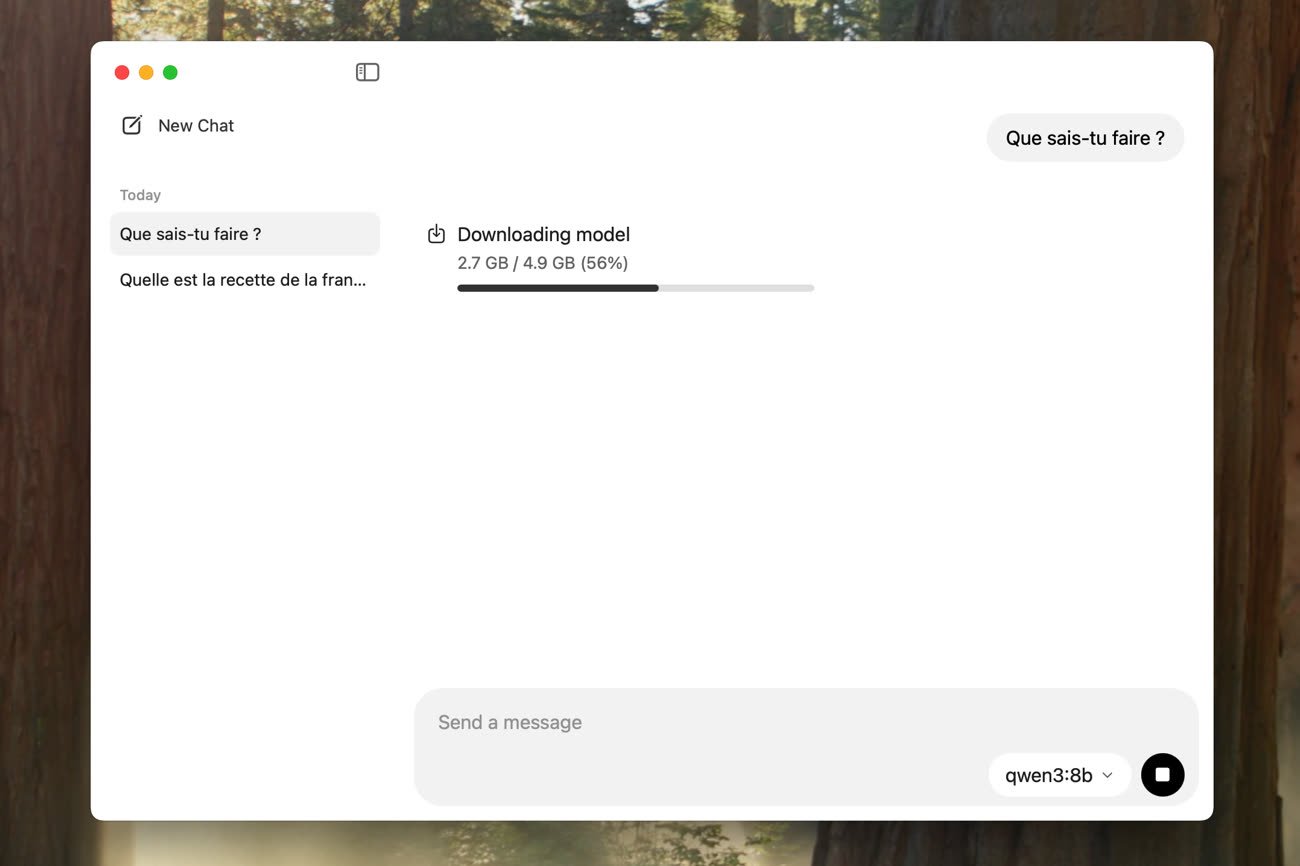

Si vous avez déjà utilisé Ollama pour télécharger des modèles, ceux-ci seront immédiatement disponibles au lancement de l’app. Sinon, l’interface peut aussi servir à télécharger un grand modèle de langage sur l’ordinateur utilisé. Le téléchargement est initié dès lors que l’on fait appel au modèle et si l’on peut reprocher le manque d’informations en amont (impossible de connaître la taille des données, ni même d’avoir une idée des ressources nécessaires pour l’exécuter), on peut saluer l’intégration parfaite. Tout est fait pour simplifier l’utilisation d’Ollama, sans avoir à apprendre comment utiliser des lignes de commande, ni même comment choisir parmi les centaines de modèles proposés sur le site.

Pour les débutants, Ollama offre une solution simple et efficace. Ceux qui auront besoin d’aller plus loin devront toujours ouvrir un terminal, mais ce n’est pas très compliqué non plus de récupérer et exécuter un modèle par ce biais. L’app améliore le confort d’utilisation et permet notamment de glisser des fichiers directement dans la fenêtre, pour l’insérer à la discussion et construire des requêtes à partir de ce qu’ils contiennent. Les développeurs préviennent que la longueur du contexte, la quantité d’informations retenues par le modèle pour faire simple, devra sans doute être augmentée pour que cela fonctionne correctement. On peut le faire depuis les réglages intégrés, sachant qu’un contexte plus long demandera aussi plus de mémoire vive.

Ollama est une app entièrement gratuite et open-source. Elle nécessite macOS 11 (Big Sur) au minimum et son interface n’est pas traduite en français.