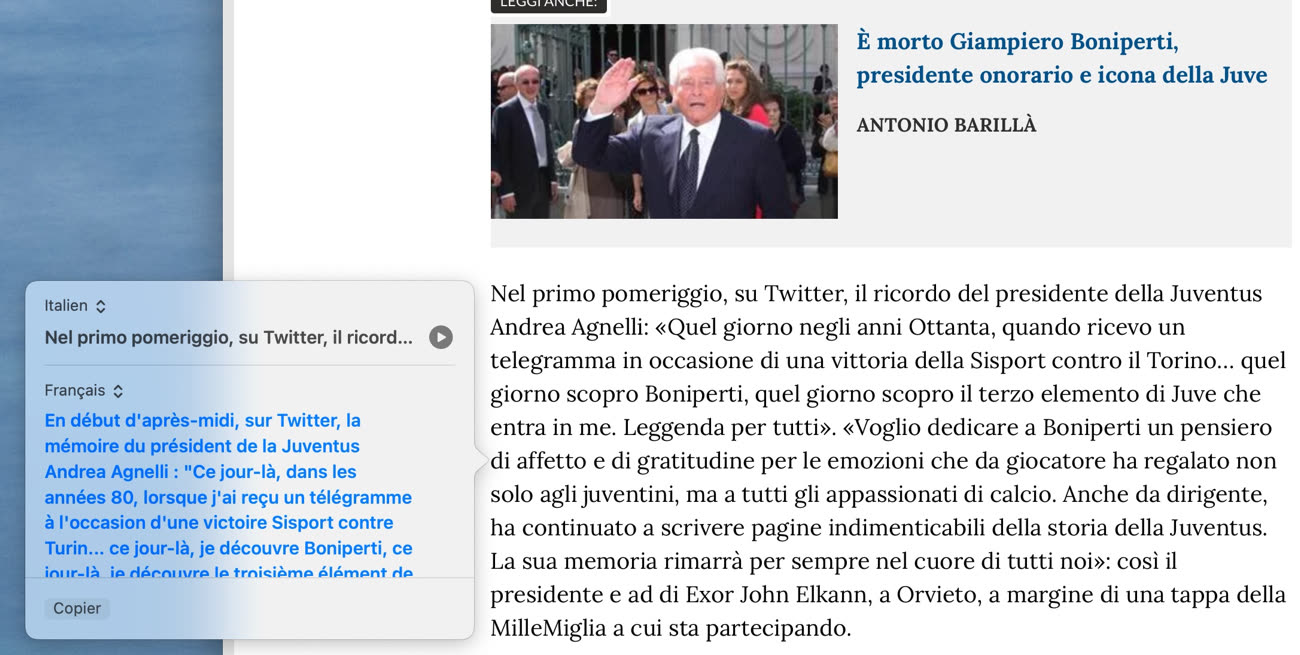

macOS Monterey généralise un service de traduction de texte au niveau du système et dont toutes les applications peuvent théoriquement profiter. Cette fonction doit également marcher sur les textes visibles dans les images.

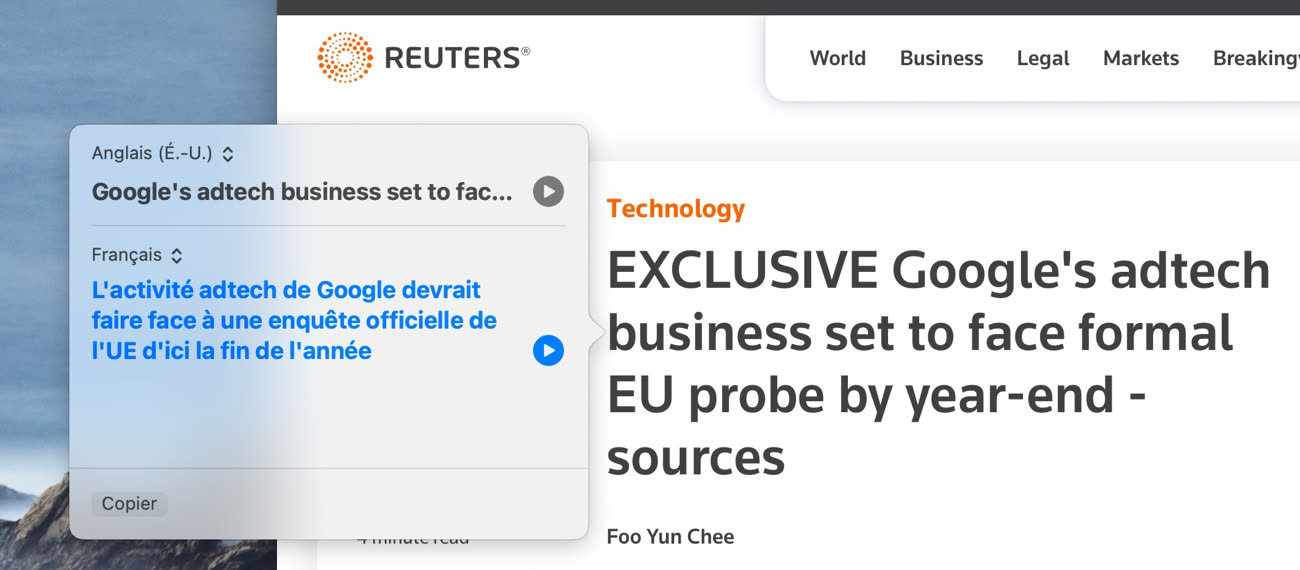

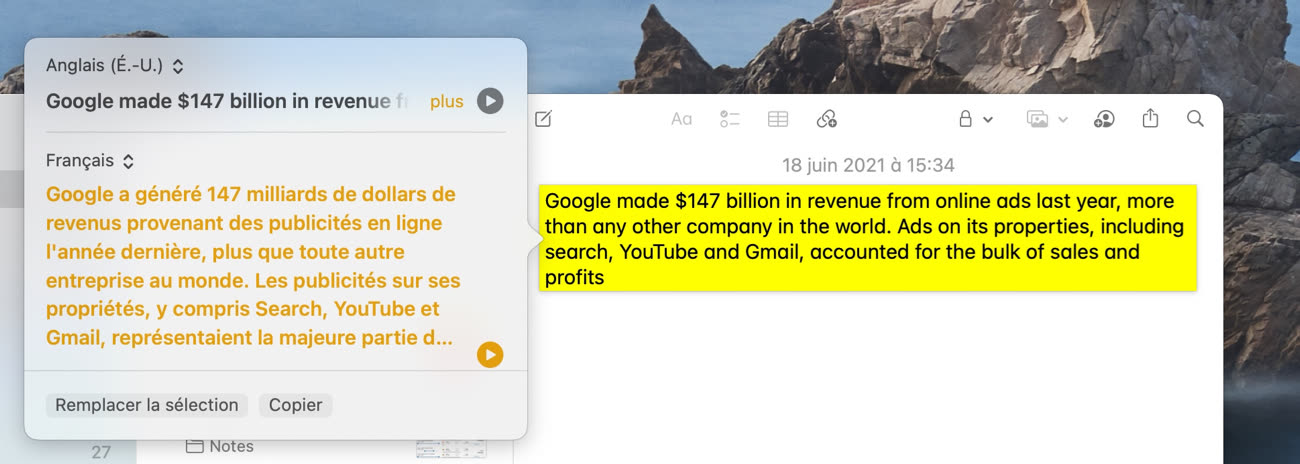

Il n'y a pas dans le prochain macOS d'application Traduire comme en a iOS depuis l'année dernière. C'est lors d'une sélection de texte dans macOS 12 que le menu contextuel propose une fonction de traduction immédiate. Un pop-up s'affiche avec le texte original et sa traduction. Deux menus permettent d'ajuster à tout moment la langue d'entrée et celle de sortie.

On a le choix entre le français, l'allemand, l'anglais britannique/américain, l'espagnol, l'italien, le portugais, le russe, le mandarin, le japonais, le coréen et l'arabe. Le texte pris et son équivalent traduit peuvent être écoutés avec l'intonation des deux langues.

Dans ce même pop-up — assez malcommode à utiliser lorsque le texte dépasse quelques lignes — un bouton copier récupèrera dans le presse-papier le contenu de la traduction proposée. Et lorsqu'on se trouve dans une application où le texte sélectionné est éditable (contrairement à celui d'une page web) on dispose d'un second bouton "Remplacer la sélection", qui fait ce qu'il suppose : il substitue le texte d'origine par sa traduction. C'est plutôt commode.

N'importe quelle application est normalement apte à utiliser cette commande. Mais encore faut-il que les développeurs exploitent les ressources standard de macOS, et dans plusieurs cas le texte sélectionné n'affichait pas la fonction de traduction.

Au-delà des applications qui gèrent le texte il y a Photos, qui stocke quantité d'images dans lesquelles des portions de texte sont visibles. Comme on l'a longuement expliqué à propos d'iOS 15, la nouvelle fonction Live Text sait détecter des caractères dans l'image et, dans le cas qui nous intéresse, les traduire aussi. Il faut toutefois un Mac M1 pour utiliser Live Text dans macOS. Sur mon modèle Intel, les textes restent de banales images.

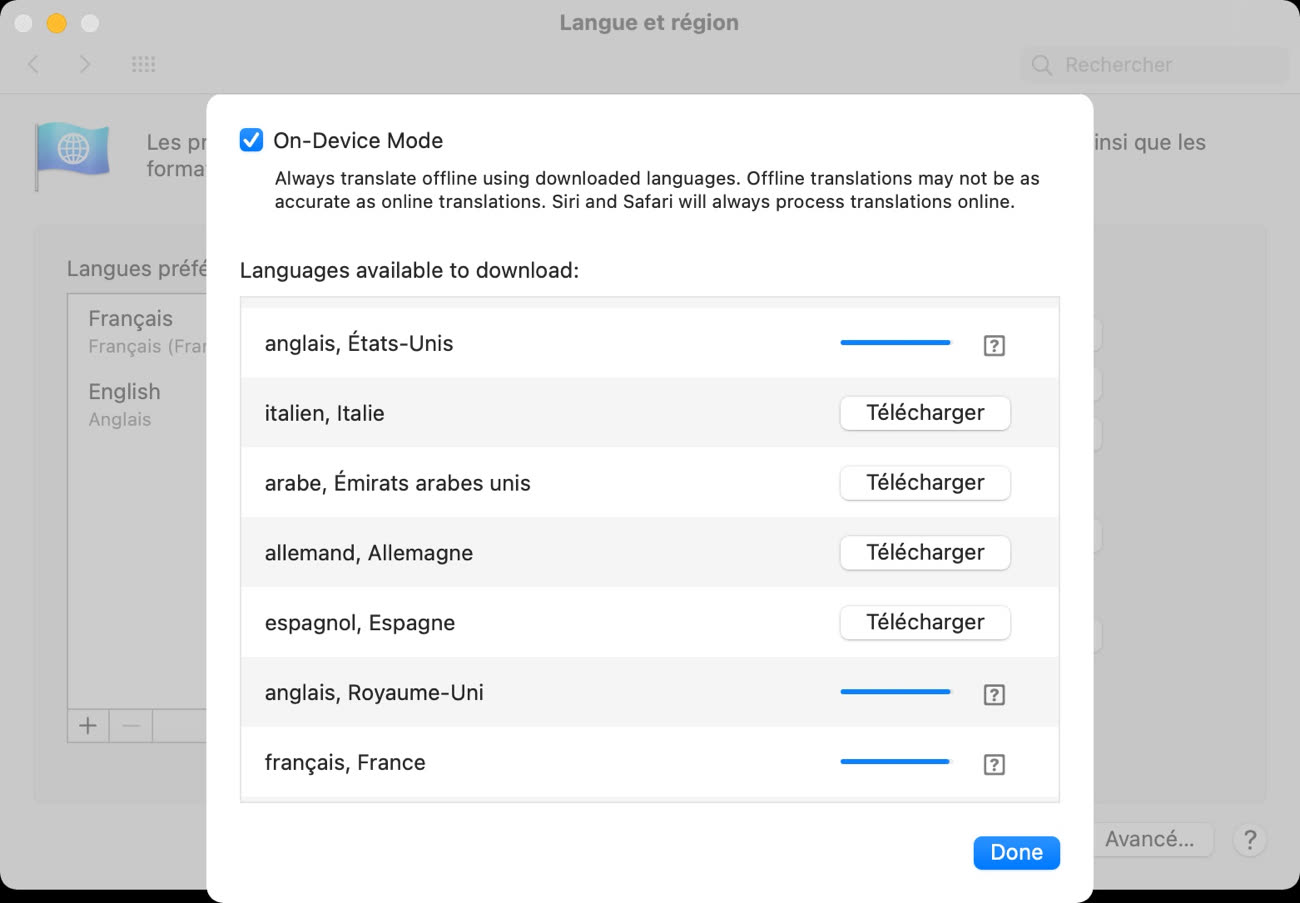

Enfin on peut préférer que ces traductions soient effectuées en local, sans envoi du texte à traiter sur les serveurs d'Apple. C'est un réglage à modifier dans les préférences du système. On y active la traduction en local et on télécharge les modules des langues dont on aura le plus besoin.

Apple prévient que la qualité de la traduction peut souffrir du fait qu'elle ne soit pas réalisée côté serveur et, surtout, que ce mode local n'est de toute façon pas pris en compte dans Safari (ni par Siri). Pour le moment ça marche de toute manière assez mal avec ma bêta, les modules linguistiques ne se téléchargent pas correctement.