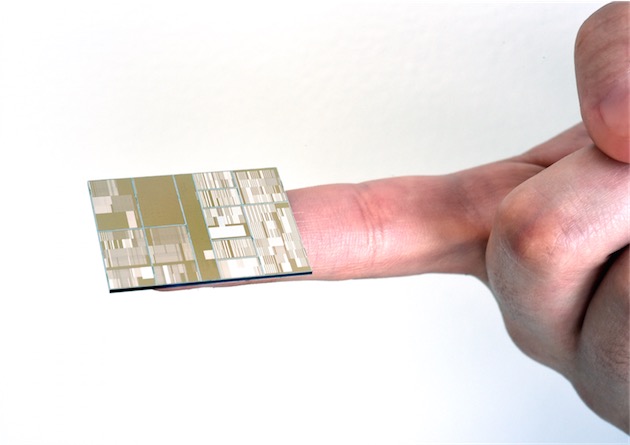

Avec l'aide de Samsung, GlobalFoundries et d'autres spécialistes des semi-conducteurs, IBM a produit la première puce 7 nm fonctionnelle au monde. Une finesse de gravure deux fois inférieure à ce qui se fait de mieux commercialement aujourd'hui et qui augure des gains de performances et de consommation sensibles.

Les processeurs Broadwell qui équipent une partie des Mac sont gravés en 14 nm, tandis que la puce A8 de l'iPhone 6 est, elle, gravée en 20 nm — le Galaxy S6 est le premier smartphone à avoir un processeur 14 nm.

Graver sous les 10 nm est un véritable challenge (le passage du 22 au 14 nm avait déjà demandé plus de temps que prévu à Intel), notamment parce que le silicium, le matériau de base habituel, n'est pas adapté à cette finesse extrême. « Le canal devient si petit que la poignée d'atomes de silicium ne peut pas transporter assez de courant », explique Ars Technica. La solution d'IBM et de ses partenaires, c'est d'ajouter du germanium afin d'exciter les électrons et ainsi permettre de faire circuler le courant nécessaire.

Mais ce n'est pas tout. Graver plus finement demande évidemment plus de précision. IBM et ses associés sont parvenus à mettre au point un processus de lithographie EUV qui a une longueur d'onde suffisamment précise pour graver sous les 10 nm.

Selon Big Blue, sa puce 7 nm est 50 % plus petite qu'une autre gravée en 10 nm. De plus, les gains de performances et de consommation seraient de 50 %, là encore face à une puce 10 nm. Rappelons que les Mac sont équipés aujourd'hui de processeur 14 nm au minimum. Ça laisse rêveur.

Intel a récemment fait part de ses intentions sur ces nouvelles finesses de gravure. La firme de Santa Clara prévoit de sortir ses premières puces 10 nm fin 2016 ou début 2017, puis 7 nm en 2018. Est-ce que la puce 7 nm d'IBM est juste un effet d'annonce pour effrayer Intel ou véritablement quelque chose de viable ?

Interrogé par Ars Technica, Mukesh V. Khare, l'ingénieur d'IBM qui supervise le projet, assure que le processus de fabrication a été pensé dès le départ pour être appliqué à grande échelle dans le futur et par toute l'industrie. Quant à l'aspect commercial, Mukesh V. Khare explique que les puces 7 nm ne seront pas moins chères (auparavant, les prix baissaient quand les puces devenaient plus petites), mais que leur rapport performances-prix en feront une technologie viable.