Avec son débit de 40 Gbit/s, le Thunderbolt 3 a entraîné une multiplication des boîtiers pour carte graphique externe. C’est une aubaine pour les possesseurs de Mac bridés par les choix d’Apple en matière de GPU. Travaillant sur un projet de deep learning très gourmand, Benoît Desnos a adjoint à son MacBook Pro 2016 une GeForce GTX 980 Ti placée dans un boîtier BizonBOX 3.

Pourquoi ne pas opter pour un Mac Pro ? Parce que le logiciel qu’il utilise, TensorFlow (à l’origine un projet de Google qui est devenu open source), exploite la technologie CUDA pour l’accélération graphique. Or, les cartes AMD ne prennent pas en charge CUDA, qui est développé par Nvidia.

Dans la gamme de Nvidia, Benoît a préféré la GeForce GTX 980 Ti à la Titan X en raison de son compromis prix-performance qui lui semblait meilleur (le tarif va du simple au double). Impossible de sélectionner une GeForce 1000 plus récente faute de pilotes compatibles sur Mac.

Quant au boîtier Thunderbolt 3, il s’est tourné vers le BizonBOX 3 en raison de son prix et de sa livraison en France. Au total, il en a eu pour près de 1 700 € (1 556 $ pour le boîtier, la carte et l’alimentation, 85 $ de frais de port et 130 € de frais de douane). Pourquoi ne pas monter un hackintosh complet à ce prix là ? Le développeur avait besoin d’un ordinateur portable et voulait aussi une solution simple à mettre en place.

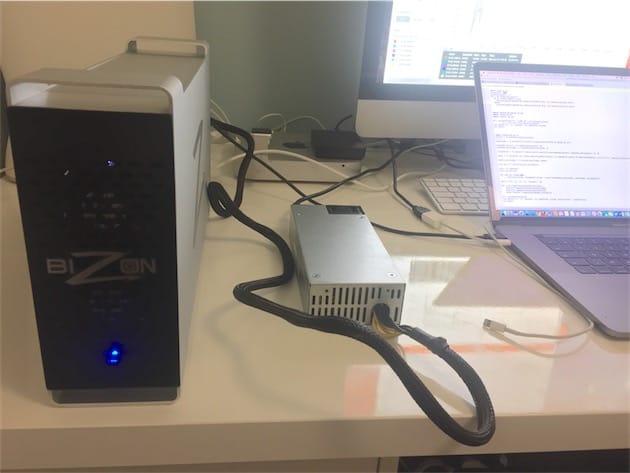

« L’assistance du site est très rapide, tant avant l’achat qu’après. J’ai dû écrire plusieurs fois pour avoir des précisions (vu le prix du matériel…) sur la compatibilité matérielle et logicielle, témoigne Benoît. L’expédition est très rapide, j’ai attendu 7 jours. L’emballage est assez sommaire : un carton, de la mousse expansée mais cela semble suffisant. Si j’avais su j’aurais également pris le câble de 2 mètres car celui de 50 cm est vraiment trop court pour pouvoir ranger la box où je veux sur mon bureau. »

Sur le boîtier en lui-même, il trouve qu’il est bien assorti avec le Mac. Par contre, le bloc d’alimentation est pour le moins élémentaire. Bizon n’a pas pris la peine de l’habiller un minimum.

À condition de lire l’anglais et d’avoir un peu de matériel supplémentaire, la mise en route est simple, d’après lui :

Les instructions d’installation sont très claires. Elles nécessitent de désactiver la protection de l’intégrité du système (SIP). Il est demandé d’utiliser le boîtier avec un écran externe, j’utilise donc mon vieil iMac 2009 comme écran avec un câble Mini DisplayPort et un adaptateur USB-C et tout fonctionne !

Une fois la solution eGPU en place, les performances changent du tout au tout. Benoît parle de temps de calcul divisé par 30 à 40 ! « Je n’ai pas vérifié exactement, mais en gros pour un traitement qui me prenait 8–10 heures sur mon MacBook Pro 2016 2,6 GHz Core i7 16 Go de RAM, je suis passé à 8–10 minutes. En plus ça me permet d’utiliser le CPU pour bosser sur autre chose sans ralentissements », indique-t-il, très satisfait de ce gain de performances. « J’ai observé que plus j’ai de données à traiter, plus l’impact en termes de perfs est important et plus le GPU est rapide par rapport au CPU », ajoute-t-il.

Cette solution a toutefois des contreparties. Le bloc d’alimentation est assez bruyant et la carte graphique siffle — l’assistance de Bizon lui a indiqué que cela pouvait arriver avec certains modèles. Le branchement à chaud fonctionne à moitié : il déclenche parfois des plantages du système.

De plus, le développeur est dépendant de la mise à disposition des pilotes par Nvidia. Ceux-ci arrivent généralement rapidement, mais il faut penser à ne pas passer sur les nouvelles versions de macOS dès leur sortie, sous peine de se retrouver sans eGPU temporairement, comme ça lui est arrivé avec macOS 10.12.3.

En conclusion, les performances sont radicalement changées dans le cas présent, mais les à-côtés (compatibilité, bruit, finitions…) sont très largement perfectibles.