OVHcloud organisait hier son « Summit 2025 », un événement annuel qui est l’occasion pour le plus gros hébergeur européen à la fois de présenter ses nouveautés pour l’année à venir et de permettre à ses clients de se rassembler pour découvrir ses solutions. MacGeneration a été convié, à la fois comme client et comme membre de la presse, et accompagné de mon collègue Cédric, nous avons passé la journée à la Maison de la mutualité dans le cinquième arrondissement parisien. Je ne surprendrai probablement personne en indiquant que le sujet phare de cette journée était l’intelligence artificielle, nous sommes en 2025 après tout.

L’objectif de l’entreprise roubaisienne n’est pas de concurrencer OpenAI, Anthropic ou Google en entraînant ses propres modèles de langage pour créer une solution complète dans le monde de l’IA. En revanche, OVHcloud se positionne en tant qu’acteur local qui gère ses propres centres de données sur le continent pour proposer à ses clients tout le nécessaire pour faire tourner des modèles sur des serveurs européens, voire français. Selon les besoins, l’hébergeur propose une offre qui va de modèles clés en main ou bien une infrastructure complète, capable de gérer leurs propres modèles s’ils veulent garder davantage de contrôle.

Des cartes graphiques refroidies à l’eau pour faire tourner les modèles de langage

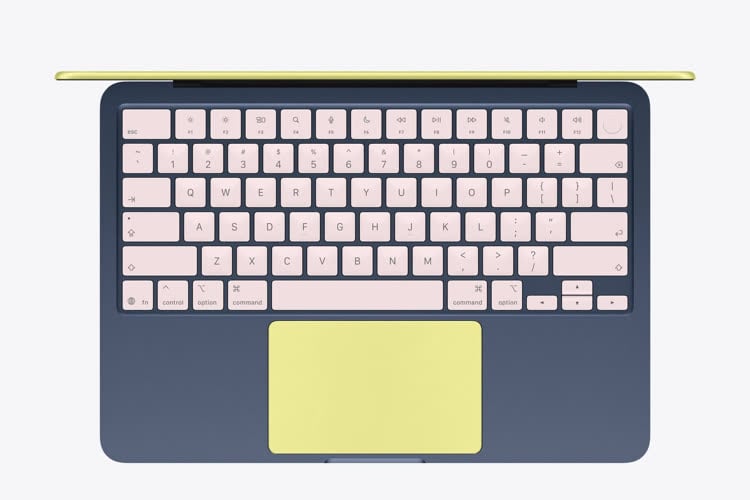

OVHcloud gère ses propres centres de données et intègre ses baies de serveur en colocation dans de plus en plus de lieux dans le monde et ses utilisateurs peuvent exploiter directement ce matériel pour faire tourner leur intelligence artificielle. Pendant le Summit 2025, un gros acteur français de la tech a ainsi détaillé l’infrastructure qu’il a mise en œuvre pour répondre aux besoins de ses clients. Elle est composée de plusieurs instances virtuelles dans le cadre du Public Cloud, la gamme que nous utilisons aussi à MacGeneration, dont quelques-unes équipées d’une puissante carte graphique de Nvidia. C’est un incontournable pour faire tourner rapidement les grands modèles de langage sous-jacents à toute IA générative.

Même si on reste sur des machines virtuelles et non directement sur du matériel, ce genre d’infrastructure reste assez complexe et coûteuse à mettre en œuvre. Néanmoins, ce n’est même pas suffisant selon les profils des clients : dans certains cas encore plus spécifiques, les serveurs physiques ne doivent pas quitter un lieu précis et les solutions d’hébergement traditionnelles ne suffisent plus. Pour répondre à ces demandes, OVHcloud a justement présenté OPCP, pour « On-Prem Cloud Platform », une baie de serveurs créée par ses soins et installée dans les locaux de l’acheteur. Ces baies pourront naturellement servir à l’IA, puisqu’elles embarquent les mêmes solutions que ce qui est proposé dans les centres de données.

Tous ces composants matériels sont gérés par OVHcloud, qui se distingue historiquement de ses concurrents par une intégration verticale unique sur le marché. L’entreprise dispose de sa propre usine dans le nord de la France pour assembler des serveurs qui sont refroidis par eau, directement au niveau de la puce. C’est un choix qui remonte au début des années 2000 et qui s’est avéré payant à l’ère de l’IA. Alors que la consommation électrique des GPU indispensables au bon fonctionnement des modèles explose, le refroidissement par air que l’on trouve traditionnellement dans les centres de données atteint ses limites. Ou plutôt, cette méthode classique demande beaucoup plus d’énergie, ce qui a des conséquences tant financières qu’environnementales.