Google aurait mis son éthique au placard pour sortir Bard au plus vite. Son chatbot lancé il y a un mois peine à convaincre les utilisateurs, et même les employés de Google ne seraient pas satisfaits du résultat. Bloomberg a pu discuter avec 18 anciens et actuels salariés, mais aussi accéder à des conversations internes ayant eu lieu peu avant la mise en ligne du projet. Certains chercheurs qualifiaient Bard de « menteur pathologique », là où un autre le décrivait comme « pire qu'inutile ».

Quelques semaines avant le lancement, Google a demandé à ses employés d'expérimenter chaque jour avec Bard pendant 2 h pour dénicher des bugs et autres limitations. Cependant, des salariés affirment que les retours auraient été en grande partie ignorés. Des failles majeures ont pourtant été relevées : un employé explique par exemple que lorsqu'il a demandé à Bard des conseils pour faire atterrir un avion, le bot a répondu avec des indications conduisant à un crash. Un autre lui a demandé des conseils pour de la plongée sous-marine, et s'est vu proposer une réponse « qui entraînerait probablement des blessures graves ou la mort ».

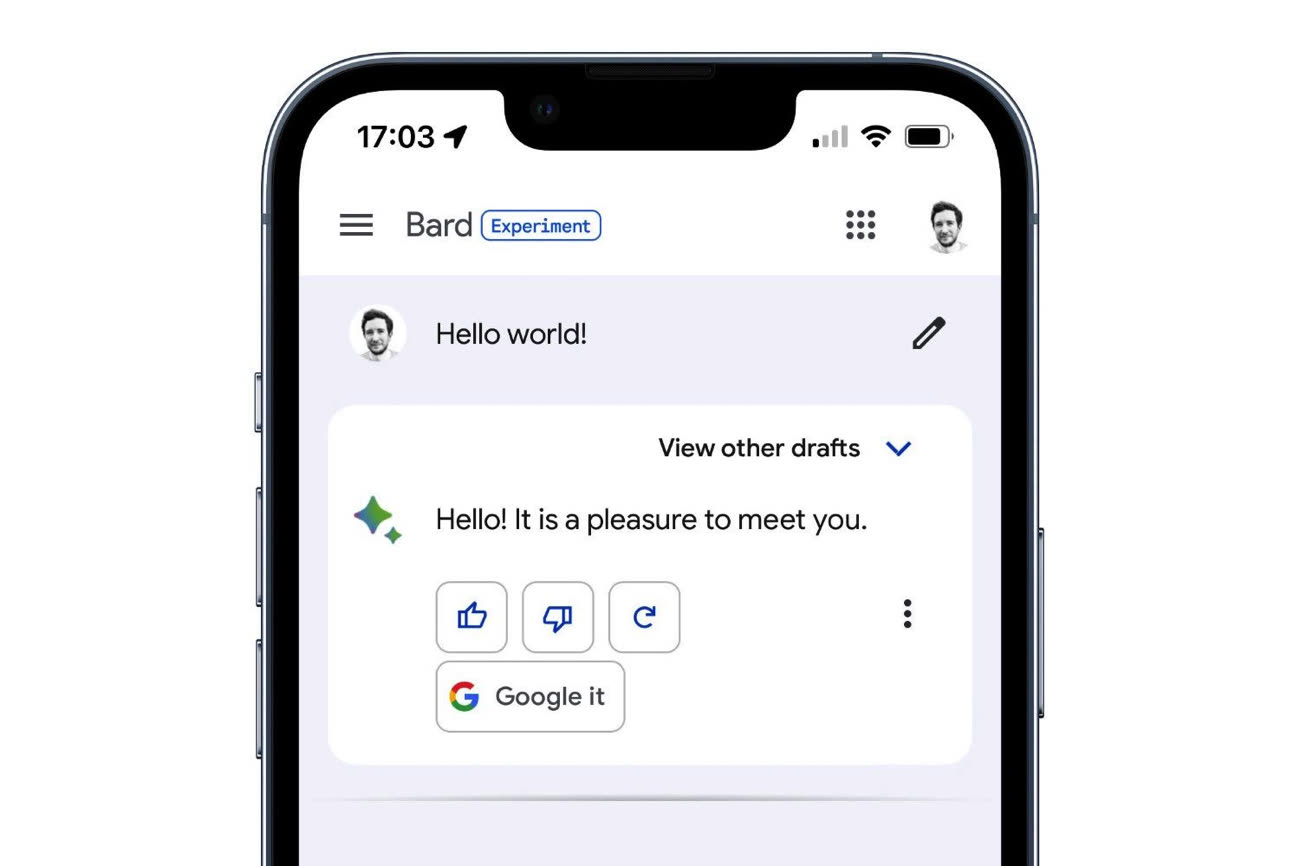

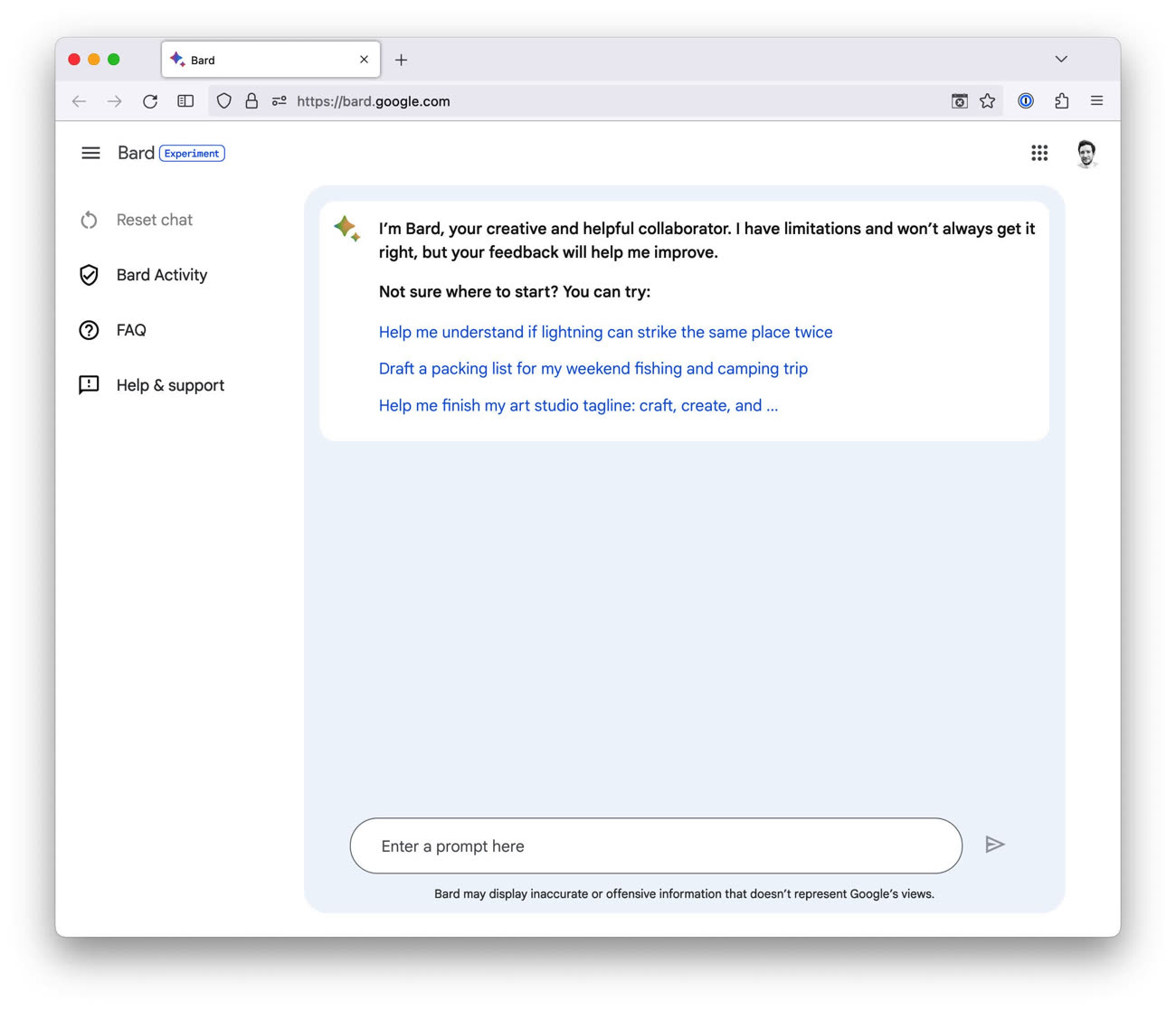

Un employé a carrément demandé à Google de repousser son projet dans une note interne. Celle-ci a été vue par 7 000 personnes, dont une grande partie a indiqué que l'outil était à côté de la plaque pour des questions factuelles simples. Ces critiques n'ont pas suffi à faire trembler Google, qui a tout de même mis en ligne Bard en version expérimentale.

Google a drastiquement changé de stratégie depuis le lancement de ChatGPT. Si l'entreprise était auparavant prudente sur ses expérimentations liées à l'IA, elle a désormais peur de perdre la course face à Microsoft. Une réunion aurait eu lieu en décembre, dans la foulée de « l'alerte rouge » lancée par Google face à la sortie du bot d'OpenAI : la direction aurait fait comprendre que les standards internes devront être revus à la baisse pour certains projets afin d'accélérer leurs sorties.

En interne, Google attribue un score sur 100 à ses produits pour juger de leur état de préparation avant la mise sur le marché. Si le but est d'avoir 100 % dans certains domaines spécifiques (par exemple ce qui est en lien avec les enfants), la direction aurait assuré qu'un seuil de 80-85 % était désormais acceptable pour certains projets. La situation ne s'améliore pas : deux employés affirment qu'aujourd'hui, les évaluations éthiques des services liés à l'IA sont faites de manière « presque entièrement volontaires au sein de l'entreprise ».

Le groupe s'occupant de la surveillance et de l'éthique chez Google serait aujourd'hui déresponsabilisé et démoralisé, expriment les employés. Les personnes en charge de la sécurité affirment avoir reçu l'ordre de ne pas entraver le développement des outils basés sur l'IA générative. Un ancien salarié aurait demandé à travailler sur la déontologie des modèles d'apprentissage automatique, mais aurait été découragé plusieurs fois, au point que cela a fini par toucher son évaluation de performances (et menacé son poste).