À quelques semaines de la sortie de la PlayStation 5 et de la Xbox Series X, toutes deux propulsées par des puces AMD, Nvidia a voulu frapper fort en dévoilant sa nouvelle génération de cartes graphiques pour PC (sur Mac, comme d'habitude, il faut faire une croix dessus). Les GeForce RTX série 30 vont profiter d'une nouvelle architecture, nommée Ampere, qui est censée offrir des performances jusqu'à deux fois supérieures à l'architecture Turing actuelle pour le ray tracing et l'intelligence artificielle.

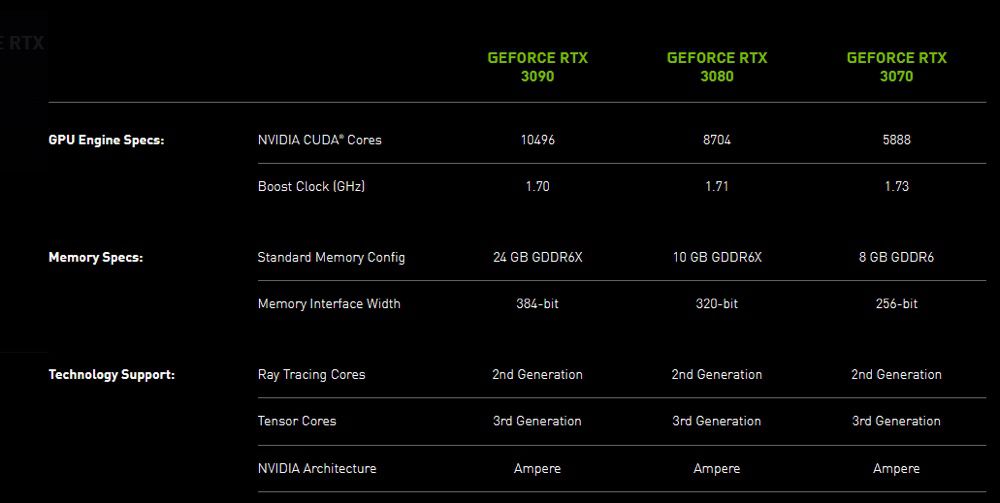

Dans le détail, plusieurs composants de base des GPU ont été améliorés : il y a de nouveaux multiprocesseurs de streaming « offrant un débit deux fois supérieur », des cœurs ray tracing de deuxième génération, des cœurs Tensor (pour l'IA) de troisième génération, de la mémoire GDDR6X plus rapide… Le tout est gravé en 8 nm par Samsung, au lieu de 12 nm pour les GeForce RTX 2000.

Les trois premières cartes de la série sont les GeForce RTX 3070, 3080 et 3090. Nvidia assure qu'il s'agit du « plus grand saut générationnel » de son histoire. Le fabricant promet par exemple une puissance brute de 30 TFLOPS sur la RTX 3080, à comparer aux 11 TFLOPS de la RTX 2080, de quoi jouer systématiquement à 60 i/s en 4K. La RTX 3090 place quant à elle la barre à 36 TFLOPS, ce qui permet d'envisager la 8K à 60 i/s avec certains jeux — mais qui a un écran 8K ?

Même si le rapport performances-watt est censé doubler par rapport à l'architecture Turing, les RTX série 30 vont consommer plus que leurs prédécesseures (jusqu'à 350 W pour la 3090). Ça aide pour augmenter significativement les performances.

En plus des cartes proposées par MSI, Gigabyte et consorts, Nvidia va encore commercialiser des modèles de son cru, nommées Founders Edition. La GeForce RTX 3070 sera en vente en octobre à 519 €, la RTX 3080 le 17 septembre à 719 € et le monstre RTX 3090 le 24 septembre à 1 549 €.

Pour marquer le coup, Nvidia et Epic ont annoncé la prise en charge de la technologie RTX par Fortnite. Quatre effets de ray tracing seront bientôt ajoutés dans le jeu : les reflets, les ombres, l'éclairage global et l'occlusion ambiante seront ainsi plus poussés. Une avancée que les possesseurs de Mac n'auront définitivement pas.