Maintenant que la transition vers les processeurs ARM est enclenchée, il reste encore quelques inconnues de taille. L’une d’elles concernait l’avenir du Thunderbolt. L’affaire n’a pas trainé, Apple a fait savoir par voie de presse que cette technologie aurait bien sa place dans ses futurs Mac.

L’autre grande interrogation porte sur les GPU. Comment Apple va-t-elle s’y prendre ? Va-t-elle tout internaliser comme elle le fait sur l’iPad et l’iPhone ou va-t-elle continuer à faire appel à un partenaire comme AMD ?

Apple n’a pas donné d’informations officielles sur le sujet, mais a semé de petits indices ici ou là. Dans sa documentation concernant le portage d’apps vers Apple Silicon, Apple glisse une petite phrase lourde de sens :

Don’t assume a discrete GPU means better performance. The integrated GPU in Apple processors is optimized for high performance graphics tasks

Que l’on pourrait traduire succinctement par ne pensez pas qu’un processeur GPU distinct est synonyme de meilleure performance. Les GPU intégrés dans les processeurs Apple sont conçus pour de hautes performances graphiques.

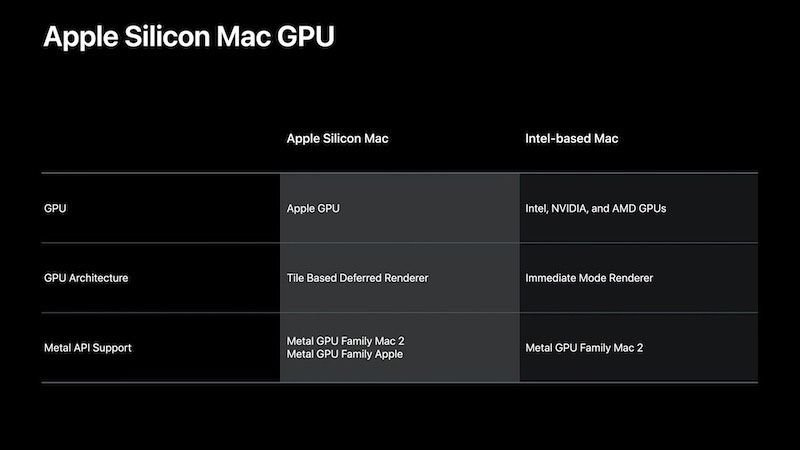

Il y a également cette diapositive parue lors d’une session de la WWDC, qui montre les différences d’un point de vue graphique entre les Mac ARM et les Mac Intel. Là où les Mac Intel ont le choix entre les GPU Intel, Nvidia et AMD, les Mac équipés Apple Silicon se limitent aux GPU d'Apple. La question que certains se posent est de savoir si Apple dit bien tout ou si elle cache encore son jeu.

Il y a plusieurs choses à observer dans la situation actuelle. Tout d’abord, il faut bien se rappeler que les démonstrations faites par Apple avec son DTK lors du keynote d’introduction de la WWDC étaient assez impressionnantes. L’Apple GPU semblait performant et était capable d’exécuter des jeux dans des conditions qui paraissent impensables sur les MacBook Air par exemple.

Pour expliquer le passage à Apple Silicon, les dirigeants d’Apple ont réexpliqué leur philosophie de design et ont insisté comme ils l’avaient fait quinze ans plus tôt sur le fameux axiome performance par watt. De ce point de vue, on imagine mal Apple faire autrement sur ses ordinateurs portables.

Reste à savoir comment Apple va s’y prendre pour rivaliser avec les cartes graphiques relativement puissantes que l’on trouve dans ses stations de travail comme l’iMac Pro ou le Mac Pro. Apple sera-t-elle en mesure de mettre au point une solution maison ? Sur ces machines, le circuit graphique sera-t-il retiré du système-sur-puce, car celui-ci est trop volumineux ? Et si c’est le cas, aura-t-on le droit à une carte graphique Apple ou provenant d’un acteur établi comme AMD ? Comme nous l’expliquions dans cet article « Quel GPU pour un futur Mac ARM ? » en amont de la WWDC, les options ne manquent pas pour Apple. Les choix architecturaux d’Apple pour ses stations de travail seront d’ailleurs assez passionnants à suivre.

Dernière inconnue souvent évoquée : l’avenir des boitiers externes eGPU. L’annonce du support des Thunderbolt sur les Apple Mac Silicon laisse à penser que ces périphériques continueront à exister.