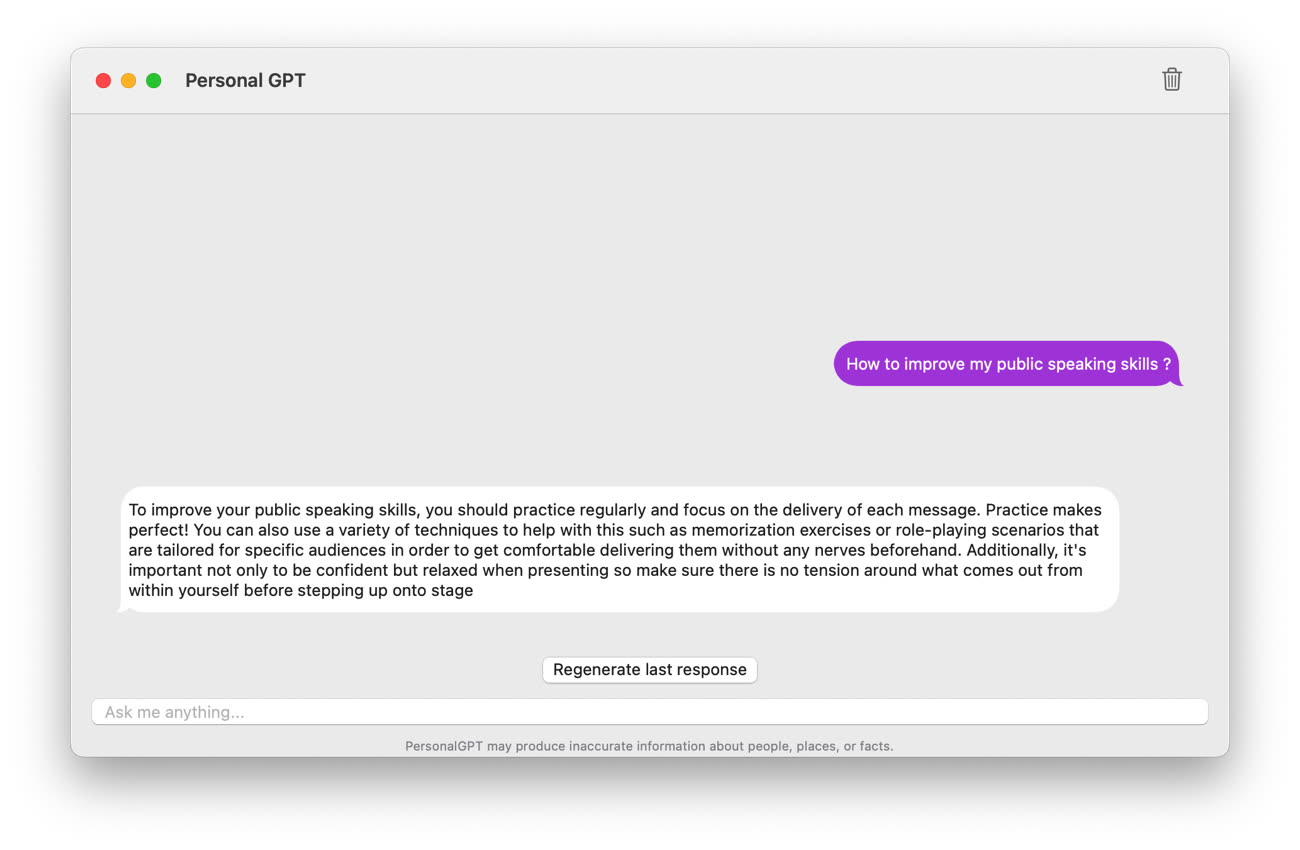

Les premières applications permettant de faire tourner un modèle de langage en local commencent à arriver sur le Mac App Store. Si cela est possible depuis plusieurs mois en mettant les mains dans le cambouis, Personal GPT propose de discuter avec un chatbot dans une interface simple, fournie clef en main et à télécharger sur la boutique d'Apple.

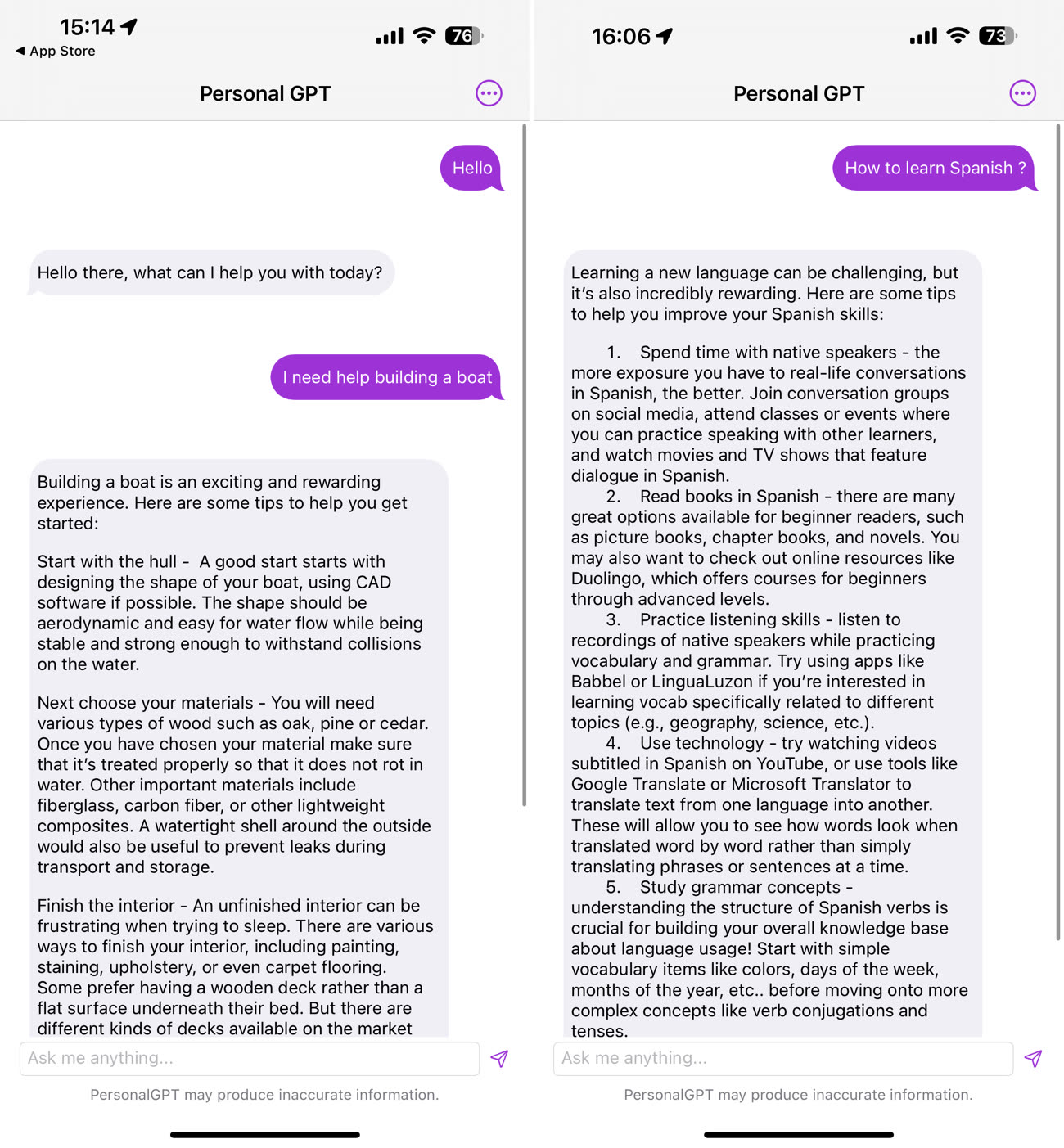

Personal GPT se base sur un modèle open source de 2,8 milliards de paramètres qui a été affiné et optimisé pour tourner sur les puces Apple Silicon. L'avantage de cette petite taille est que le chatbot répondra vite et qu'il peut tourner sur du matériel vieillissant. Étant donné qu'il s'agit d'une application universelle, le programme fonctionne également sur un iPhone ou un iPad pour peu qu'il embarque une puce A12 Bionic (iPhone XS et XR).

J'ai joué avec quelques minutes, et soyons clairs : Personal GPT ne vaut pas le coup pour le moment. Le bot embarqué est vraiment médiocre et se plante 2 fois sur 3. Il ne comprend pas vraiment le français, et même en anglais, les réponses sont souvent à côté de la plaque. Il n'est malheureusement pas possible de changer le modèle sous le capot pour avoir de meilleurs résultats, ce qui fait que l'application est assez inutile en l'état.

Si les réponses sont loin d'être au niveau, pourquoi parler de Personal GPT ? L'app a le mérite de rappeler les progrès fulgurants réalisés par la communauté open source pour ce qui est des modèles de langages. L'application peut tourner localement sur un iPhone XS sorti en 2018, et générer des réponses sans qu'aucune donnée ne soit transmise en dehors de votre appareil.

Certes, les résultats ne sont pas au niveau, mais cela reste très impressionnant quand on voit qu'il fallait d'énormes configurations pour faire tourner quoi que ce soit il y a encore quelques mois. On a récemment vu arriver plusieurs modèles entièrement open source et utilisables à des fins commerciales créés par des entreprises : on peut imaginer que leur qualité va s'améliorer dans les mois à venir.

Dolly 2.0, un modèle de langage open source utilisable à des fins commerciales

Ce type d'application ouvre la voie à d'autres programmes basés sur des modèles plus puissants, qui pourraient être très intéressants pour ceux lassés par les déboires de confidentialité d'OpenAI. Actuellement, il est possible de télécharger LlamaChat et le modèle de son choix pour avoir son propre ChatGPT local, mais cela implique pas mal de bidouille, de beaucoup se renseigner et de surmonter les bugs. L'arrivée d'applications simples à apprivoiser et dédiées à l'utilisateur moyen pourrait populariser l'utilisation de modèles de langages en local.

Sur Reddit, le développeur de Personal GPT a expliqué qu'il expérimentait avec des modèles de 7 milliards de paramètres qui devraient proposer des réponses plus convaincantes. À l'avenir, il envisage d'ajouter une prise en charge de la dictée, de Raccourcis et d'ajouter un historique de conversation. Difficile de vous recommander d'investir 12 € (6 € en période de promo) pour cette application, mais son évolution et l'arrivée de la concurrence sont à suivre de près.