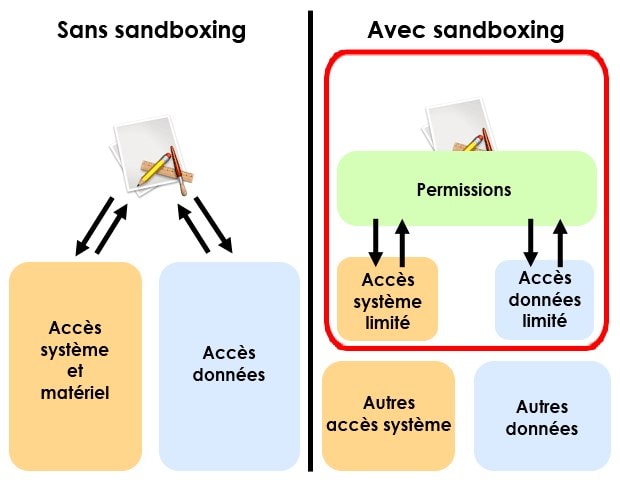

Les navigateurs web sont des vecteurs critiques de piratages informatiques. Afin de réduire les risques de sécurité, les éditeurs les isolent (comme les autres applications) dans des bac à sable (sandbox). Avec la prochaine version majeure de Windows 10, Microsoft va aller plus loin en faisant tourner son navigateur Edge dans une machine virtuelle.

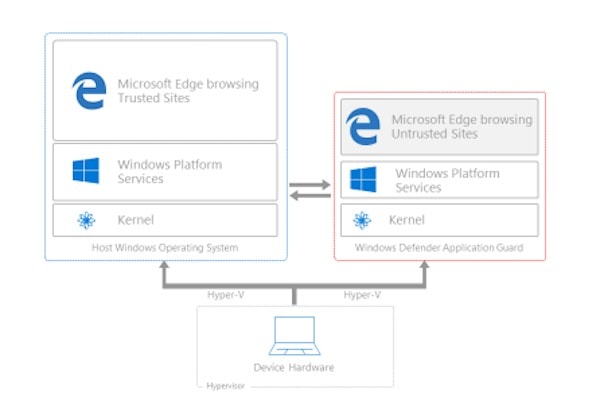

Les machines virtuelles, qui servent habituellement à faire tourner un OS à l'intérieur d'un autre OS, sont encore plus coupées du système que les sandbox. Elles ne peuvent pas voir les processus de la machine hôte, ni accéder à son espace de stockage et encore moins modifier l'OS principal.

En plaçant Edge dans sa propre machine virtuelle, Microsoft réduit ainsi drastiquement les risques d'infection. Si un malandrin venait à compromettre le navigateur, il resterait bloqué (en théorie) dans la machine virtuelle où il n'y a aucune donnée sensible.

Cette mesure de sécurité baptisée Application Guard entraîne aussi des contreparties qui font qu'elle est réservée à Windows 10 Enterprise — au moins dans un premier temps.

Les cookies des sites web ne peuvent pas être conservés, parce que la machine virtuelle est supprimée quand le navigateur est fermé. Cela signifie qu'il faut se reconnecter aux sites à chaque lancement. Les administrateurs auront tout de même la possibilité de désigner des sites sûrs qui n'utiliseront pas la machine virtuelle.

Par ailleurs, l'utilisation simultanée d'une autre machine virtuelle ne sera pas possible. Et puis il y a la question des performances que Microsoft n'a pas éclaircie. Application Guard, qui arrivera en 2017, n'en reste pas moins intéressant.