Durant la conférence du CES sur la gestion des données personnelles, Jane Horvath, Senior Director of Global Privacy chez Apple, a brièvement dit qu'Apple avait mis en place un système pour débusquer d'éventuels images pédophiles ou pouvant laisser supposer des faits de maltraitance sur enfants, qui sont stockées sur iCloud.

C'était à la suite de ses propos fustigeant l'idée de chercher à installer des portes dérobées dans les systèmes de chiffrement en espérant résoudre certains grands maux de ce monde. Comme le rapporte The Telegraph, elle a ajouté : « Nous employons certaines technologies pour aider à dépister des cas d'abus sexuel sur des enfants. »

Sans plus de détails de sa part sur ces outils en question, un porte-parole d'Apple a renvoyé vers une page du site contenant un peu plus d'informations. Celles-ci ont été publiées pour la première fois à l'automne dernier, comme le relevait MacObserver à l'époque.

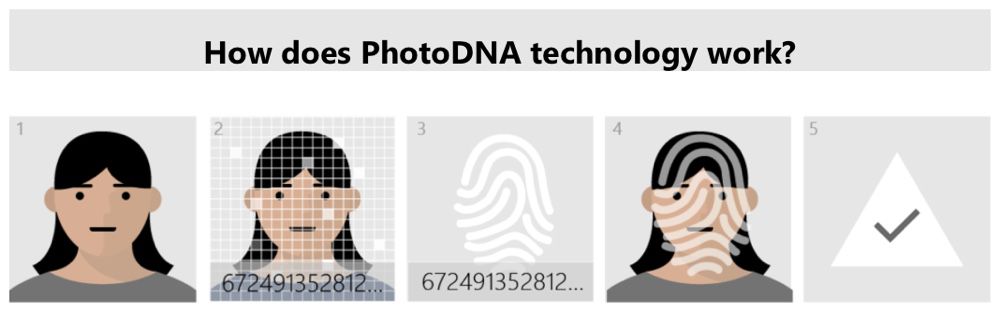

Apple utilise la technologie de correspondance d'images pour rechercher et signaler l'exploitation d'enfants. Tout comme les filtres anti-spam dans les e-mails, nos systèmes utilisent des signatures électroniques pour détecter des abus présumés sur des enfants. Nous validons chaque correspondance par un examen individuel. Les comptes avec un contenu relatif à l'exploitation d'enfants enfreignent nos conditions d'utilisation et tous les comptes que nous trouvons avec ce type de contenus seront désactivés.

Dans son article sur MacObserver, Andrew Orr supposait qu'Apple se repose sur PhotoDNA, inventé par Microsoft et mis à disposition du National Center for Missing & Exploited Children (NCMEC). Ce système créée une signature électronique (une suite de chiffres) à partir d'une photo et la compare avec les signatures générées à partir d'images connues pour contenir de telles scènes.

Apple ne dit pas comment elle analyse ces images sur iCloud où elles sont stockées chiffrées, et si elle utilise PhotoDNA. Cela semble plausible puisqu'il faut une base conséquente et spécialisée, comme celle du NCMEC (45 millions d'entrées), avec laquelle comparer ses propres signatures.