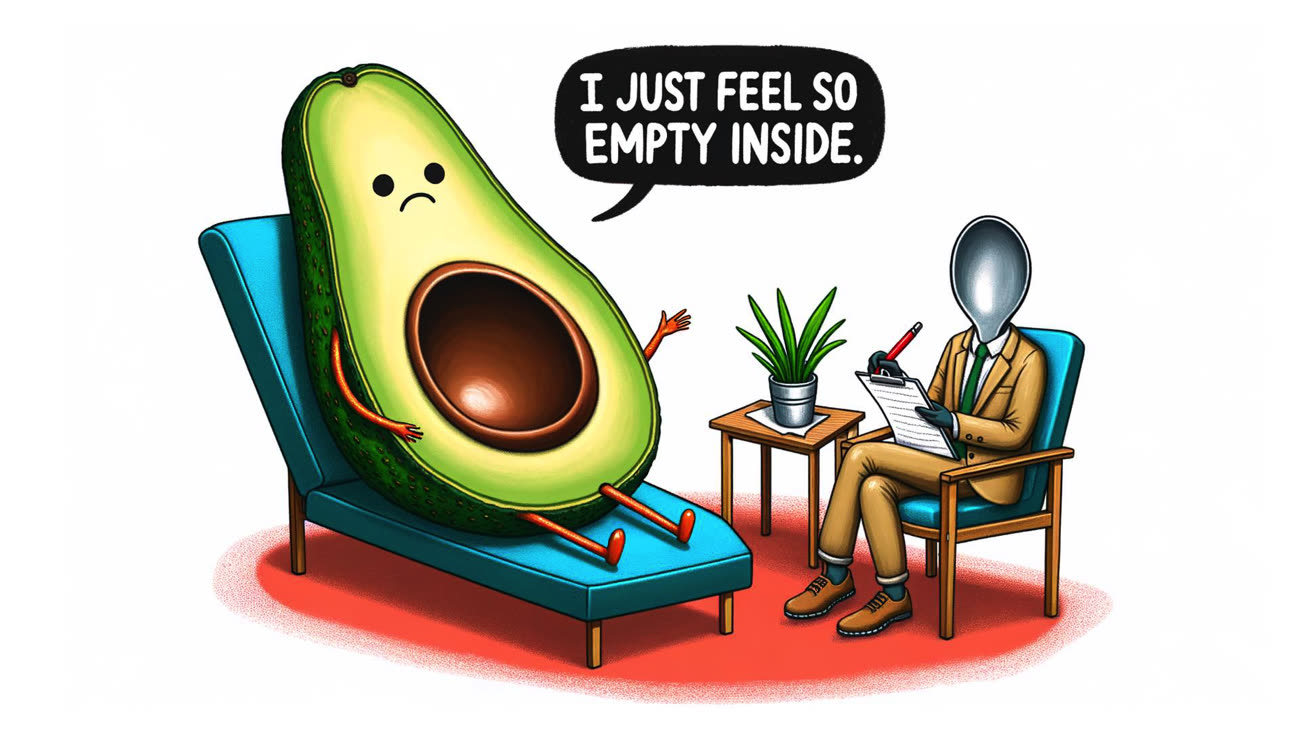

OpenAI a présenté une nouvelle version de DALL-E, son modèle d'intelligence artificielle qui permet de générer une image à partir d'une simple description textuelle. Cette troisième mouture semble radicalement plus puissante, et est désormais en mesure d'écrire correctement du texte dans une image. Le dessin ci-dessous a été réalisé grâce à la commande suivante :

Illustration d'un avocat assis sur la chaise d'un thérapeute, disant « Je me sens si vide à l'intérieur », avec un trou de la taille d'une assiette en son centre. Le thérapeute, une cuillère, prend des notes.

C'est une belle avancée, car le texte était jusqu'à présent un des gros défauts des images générées par IA : les lignes affichées donnaient généralement un gloubi-boulga incompréhensible. OpenAI n'est pas la seule à progresser dans le domaine, la dernière version de Stable Diffusion présentée dans le courant de l'été s'étant également améliorée sur ce point.

La dernière version de Stable Diffusion gère mieux les mains et les textes dans les images

OpenAI explique que DALL-E 3 permet de plus facilement créer des images intéressantes sans qu'il soit nécessaire d'avoir à bidouiller sa requête en glissant des termes ciblés spécifiques. Les alternatives comme Midjourney ou Stable Diffusion impliquent souvent d'ajouter des mots précis pour obtenir un résultat convenable, comme « hyper réaliste », « détaillé », « qualité photographique », « HDR » etc. Cela ne devrait donc plus être le cas ici, ce qui va simplifier la création. Le système gère désormais plus efficacement les petits détails comme les mains, et se veut plus fidèle aux descriptions données.

DALL-E gagne une intégration avec ChatGPT, ce qui va permettre de retoucher une image simplement en discutant avec le bot. On pourra lui demander de l'aide pour trouver de l'inspiration, et ChatGPT sera en mesure de créer une image à partir d'une conversation.

OpenAI tente de répondre à la pression montante autour des IA génératives, qui sont formées à partir d'énormes quantités de contenus trouvés en ligne sans se soucier des questions de droits d'auteurs. Le service ne pourra pas reproduire le style d'un artiste vivant, et les créateurs pourront remplir un formulaire demandant à OpenAI de ne par utiliser leur création pour l'entrainement de leurs prochains modèles. Comme par le passé, l'IA ne pourra pas créer d'image à caractère violent, sexuel ou représentant une célébrité.

Cette nouvelle version de Dall-E est actuellement proposée en avant-première pour les chercheurs. Elle sera disponible pour les clients ChatGPT Plus et Enterprise en octobre, via l'API et dans les Labs plus tard cet automne.