Adobe est revenu sur la démonstration d'une possible future fonction de défloutage dans Photoshop. Présentée dans le cadre de la conférence MAX 2011, elle avait été filmée mais la qualité de la vidéo ne permettait pas d'apprécier le résultat.

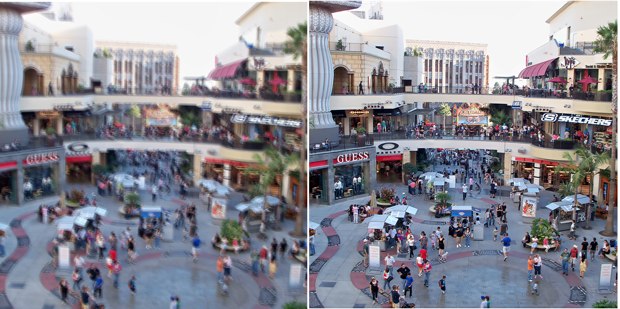

Pour rappel, l'objectif est de rendre leur netteté à des images, mais aussi des textes, sortis flous à la suite d'un mouvement. L'algorithme corrigera donc des flous de bougé, mais pas une mauvaise mise au point. Le plug-in utilisé pendant la démo analysait l'image et tentait de définir le mouvement de l'utilisateur qui avait généré ce flou (lire Photoshop : demain le défloutage en un clic). Deux images avant/après ont été mises en ligne pour montrer concrètement ce que cela donne (cliquez pour agrandir).

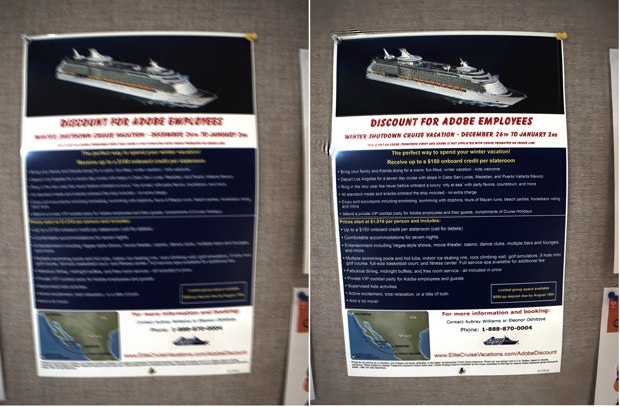

Une autre (ci-dessous) montre les limites de cette technologie dans son état actuel. L'image de cette personne avec son chien ne présente pas de contours suffisamment précis pour être défloutée. Le résultat le montre, l'image traitée n'est guère différente de l'image source. Autre situation dans laquelle l'algorithme est à la peine, si l'on bouge pendant que l'on photographie une personne en mouvement. Le sujet aura du mal a être déflouté.

Un contexte où cette technologie peut être utile dès à présent, est celle des enquêtes policières explique Adobe. Par exemple lorsqu'un enquêteur doit déflouter une simple plaque d'immatriculation ou un numéro de téléphone. Mais de façon plus générale, cette fonction est encore loin de pouvoir répondre à tous les cas de figure. Il ne faut pas espérer la voir rejoindre Photoshop dans l'immédiat. Une vidéo de bien meilleure qualité de cette démo est maintenant visible sur Adobe TV.

Pour rappel, l'objectif est de rendre leur netteté à des images, mais aussi des textes, sortis flous à la suite d'un mouvement. L'algorithme corrigera donc des flous de bougé, mais pas une mauvaise mise au point. Le plug-in utilisé pendant la démo analysait l'image et tentait de définir le mouvement de l'utilisateur qui avait généré ce flou (lire Photoshop : demain le défloutage en un clic). Deux images avant/après ont été mises en ligne pour montrer concrètement ce que cela donne (cliquez pour agrandir).

Une autre (ci-dessous) montre les limites de cette technologie dans son état actuel. L'image de cette personne avec son chien ne présente pas de contours suffisamment précis pour être défloutée. Le résultat le montre, l'image traitée n'est guère différente de l'image source. Autre situation dans laquelle l'algorithme est à la peine, si l'on bouge pendant que l'on photographie une personne en mouvement. Le sujet aura du mal a être déflouté.

Un contexte où cette technologie peut être utile dès à présent, est celle des enquêtes policières explique Adobe. Par exemple lorsqu'un enquêteur doit déflouter une simple plaque d'immatriculation ou un numéro de téléphone. Mais de façon plus générale, cette fonction est encore loin de pouvoir répondre à tous les cas de figure. Il ne faut pas espérer la voir rejoindre Photoshop dans l'immédiat. Une vidéo de bien meilleure qualité de cette démo est maintenant visible sur Adobe TV.