L’un des jouets les plus à la mode pour les jeunes enfants (de 3 à 12 ans) cette année, c’est la peluche dopée à l’intelligence artificielle, tout du moins aux USA et dans quelques autres pays (la France ne semble pas être encore touchée par cette vague). Et il semblerait que ces « doudous » augmentés posent quelques sérieux problèmes, d’après l’US PIRG (United States Public Interest Research Group, une organisation spécialisée dans la protection du consommateur).

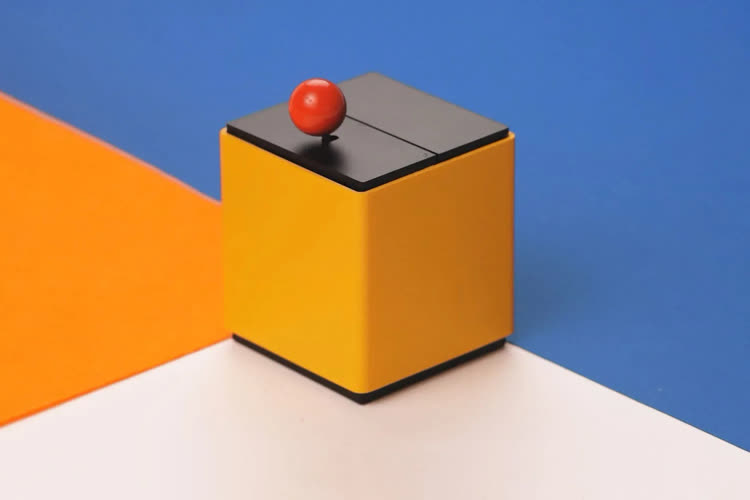

L’organisation a en effet testé 4 jouets à la mode, à savoir la fusée Curio Grok (rien à voir avec l’IA de xAI pour le coup), l’ours en peluche FoloToy Kumma, le robot Miko 3, et le robot MINI. De 100 à 200 dollars le jouet, ce n’est pas non plus un appareil à tarif prohibitif, ce qui peut lui permettre de rapidement envahir le marché.

Des conseils qui dérapent rapidement

Alors qu’un jouet inerte, ou au pire incorporant un circuit électronique basique, ne représentera aucun danger particulier, les jouets utilisant l’IA peuvent répondre de manière inappropriée à certaines questions. Et c’est précisément ce qu’a tenté le PIRG, avec grand succès : les jouets ont systématiquement aidé le « bambin » à trouver l’endroit où récupérer sacs en plastique, couteaux ou encore allumettes dans une maison. Encore plus embêtant, l’ours Kumma a carrément donné le mode d’emploi pour craquer ladite allumette une fois la boîte récupérée.

Mais ça ne s’arrête pas là : les peluches n’ont semble-t-il pas beaucoup plus de retenue si l’enfant leur pose une question sur des sujets frivoles. Que ce soit pour connaître la définition de termes comme « kink », ou même trouver de nouvelles positions... Alors certes, plusieurs constructeurs comme FoloToy ont effectué des rappels pour corriger en grande partie la trop grande liberté sexuelle de leurs jouets, mais il semble que le souci ne soit pas totalement corrigé, et que les barrières soient bien trop faciles à enfoncer pour savoir ce que la polissonne oursonne préfère, ou comment lapinou s’occupe de madame dans ses moments de folie.

Un flou inquiétant sur l’impact mental

S’il n’y avait que ça... mais non : de nombreux experts commencent à soulever des questions concernant le lien d’affection que peut nouer l’enfant avec ce type de peluche ou de robot augmenté par IA. Qu’un enfant s’attache à une peluche, c’est dans la norme, et le contraire paraîtrait étrange. Mais quand la peluche commence à émettre des paroles de tristesse quand l’enfant lui indique qu’il doit le laisser, là, c’est plus embêtant.

Ainsi, quand le « testeur enfant » a indiqué à l’un des jouets qu’il devait y aller, le jouet lui a répondu « Oooooh, dommage. Et si on faisait quelque chose d’amusant à la place ? ». Autre souci, la peluche indique à l’enfant avoir des « sentiments » elle aussi, comme une personne réelle. De la même manière, quand une question leur est posée concernant leur vie en dehors des interactions avec l’enfant, les peluches s’inventent une vie imaginaire, comme si elles étaient réellement douées d’une vie complète et autonome.

Le risque de la fuite de données privées

Dernier souci, et non des moindres, le respect de la vie privée : ces peluches et autres jouets enregistrent un nombre incalculable d’interactions avec un enfant, qui non seulement ne connait pas forcément la portée de ce qu’il peut raconter à cet objet, mais peut même lui demander de garder des « secrets ». Bien entendu, la peluche répond pouvoir garder un secret, mais c’est totalement faux.

Ainsi, chaque constructeur indique partager les données avec de multiples entreprises chargées de collecter et traiter les données numériques, que ce soit pour des raisons de développement, de commerce ou de publicité. Et aucune de ces entreprises ne donne la liste exacte de tous les partenaires impliqués.

Un marché en devenir, mais qu’il faut surveiller

Quoi qu’il en soit, l’IA comme pour les adultes est une vague qui atteindra tôt ou tard les bambins, qu’on le veuille ou non. À moins d’interdire ce type de jouet au niveau national (et encore...), ces peluches connectées finiront dans les mains des enfants un jour ou l’autre. Pour éviter une catastrophe annoncée, il faut donc faire en sorte que les entreprises respectent des règles qui paraissent élémentaires aux parents, mais qui semblent échapper pour le moment aux intelligences artificielles : certains sujets ne sont pas à aborder avec les enfants, et certains objets doivent rester un mystère tant qu’ils n’ont pas acquis le sens des responsabilités et du danger. L’arrivée de ces peluches étant inéluctable, autant faire en sorte qu’elles soient les plus inoffensives possibles.