Anthropic amorce un nouveau virage en annonçant que le contenu des échanges entre Claude et les utilisateurs servira à l'entraînement de ses modèles. Il y a quelques exceptions et il y a surtout la possibilité de s'y opposer.

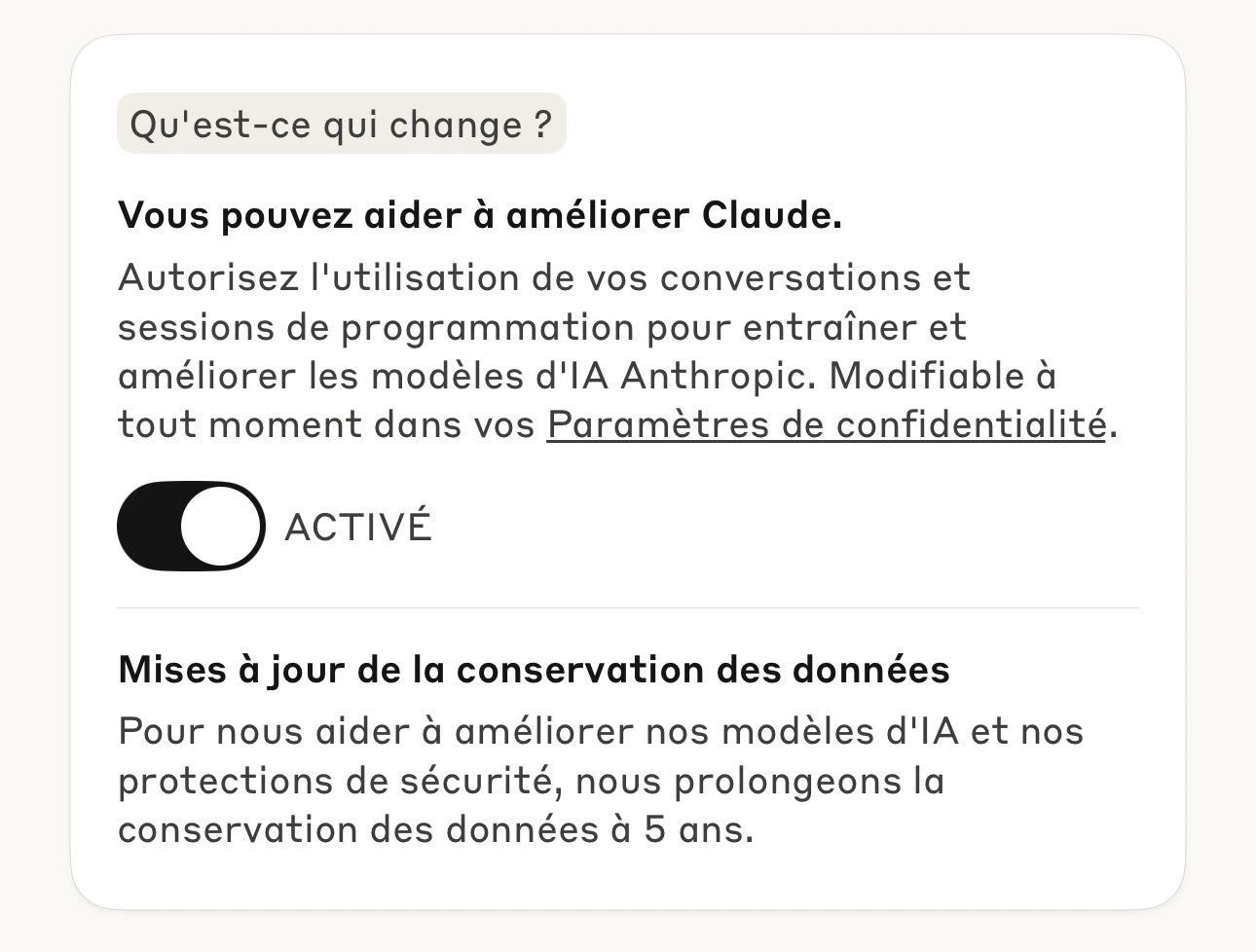

Si vous utilisez Claude tous les jours vous avez probablement déjà vu apparaître le message d'information, mais vous l'aurez peut-être validé sans y prêter plus attention. Cependant, la demande d'autorisation était activée par défaut dans ce panneau d'information… On peut toutefois y remédier.

Jusque-là Anthropic n'exploitait ces textes échangés avec Claude que sur proposition de l'utilisateur. À compter du 28 septembre, ce sera fait de manière automatique pour les trois forfaits Free, Pro et Max (Claude Code inclus). Ceux qui vont y échapper sont les contrats Équipe, Entreprise, Secteur public, Éducation ou les tiers qui proposent l'IA au travers de son API.

Anthropic défend ce changement de pied par la nécessité d'améliorer ses futurs modèles en utilisant des réponses déjà fournies et d'en profiter pour détecter des usages malveillants. Il a été constaté que l'IA pouvait fournir des renseignements utiles pour mener des campagnes d'extorsion de fonds, par exemple.

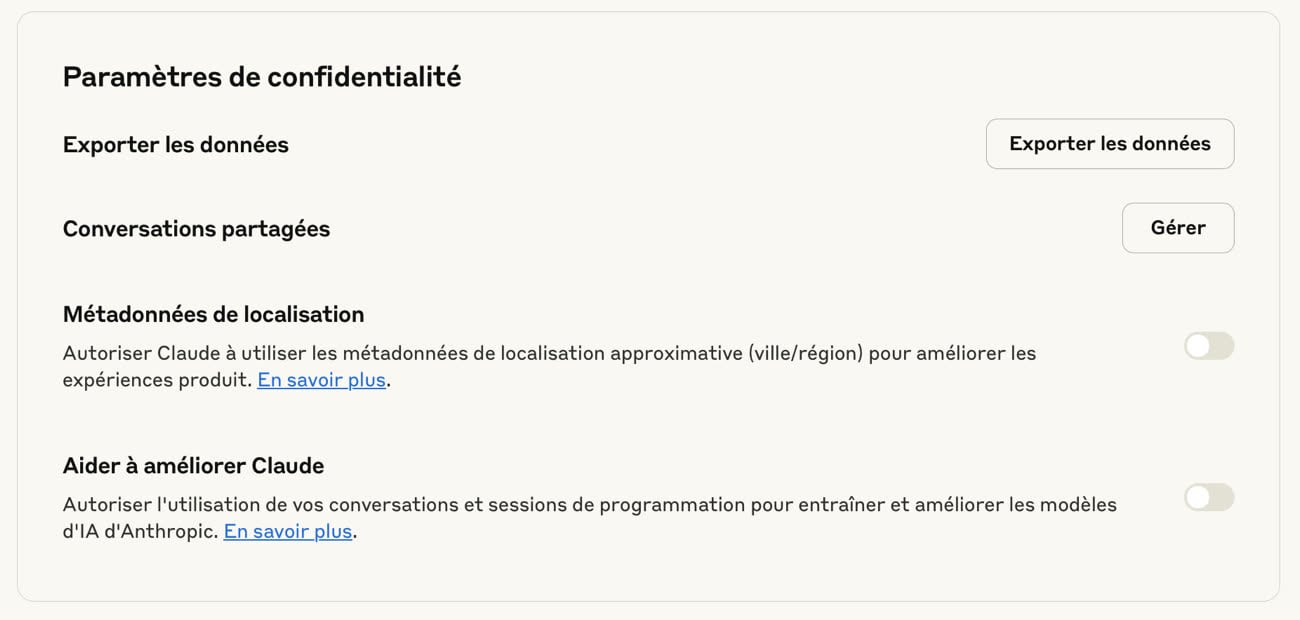

Le choix fait pour l'utilisation de ses données peut être modifié à tout moment. Il faut se rendre, sur le site web, dans les Paramètres puis Confidentialité. C'est à cet endroit que l'on trouve aussi l'autorisation donnée à Claude de récupérer les métadonnées de localisation de l'utilisateur.

À tout moment une autorisation donnée pour l'entrainement peut être révoquée. Les phases d'entrainement en cours continueront de se servir des informations échangées avec Claude jusqu'à cette date, mais les prochaines excluront ces précédentes données et les échanges qui suivront.

Source :