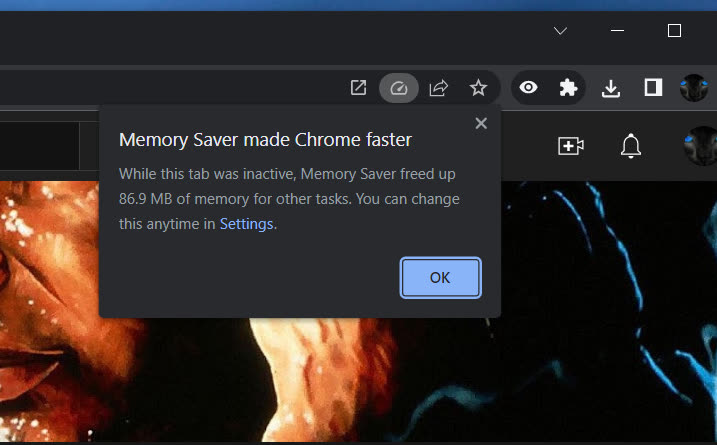

Google cherche à optimiser la consommation de RAM de Chrome. Le navigateur devrait bientôt indiquer à l'utilisateur la quantité de mémoire économisée lorsqu'un onglet est inactif, une fonction déjà disponible sur Edge depuis quelque temps. La nouveauté (pour le moment réservée aux développeurs) a été repérée par un utilisateur de Reddit.

Comme on peut le voir sur cette capture d'écran, un popup indiquera clairement la quantité de mémoire économisée pendant la période où l'onglet était inactif. On pourra obtenir l'information en cliquant sur une nouvelle icône dans la barre d'URL. Une liste blanche sera proposée via les réglages afin d'éviter de mettre en veille des onglets importants.

Cette nouveauté sera pratique pour rapidement détecter les pages lourdes, mais aussi constater l'efficacité de la nouvelle fonction « Memory Saver » de Google. Ce mode d'optimisation des performances est apparu il y a peu sur les versions de Chrome pour développeur. Il se cache dans un nouvel onglet « Performances » des réglages et permet de récupérer la mémoire des onglets inactifs.

Google a aussi dans ses cartons un nouveau mode d'économie d'énergie. Celui-ci va offrir de limiter l'activité en arrière-plan et les effets visuels lorsque la batterie de l'ordinateur passe sous la barre des 20 %.

Source :