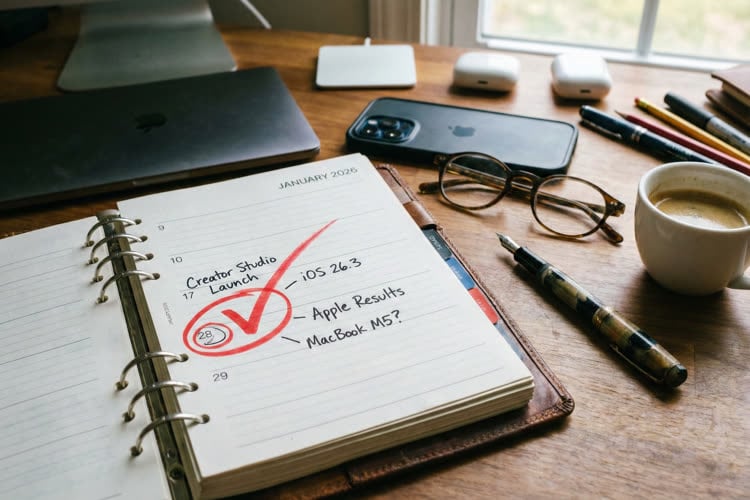

Aura-t-on le droit à de nouveaux MacBook Pro d’ici la fin du mois ? Cette invitation peut laisser penser que la fin janvier sera nettement plus mouvementée que prévu du côté de Cupertino. Apple a en effet convié une poignée de créateurs triés sur le volet pour une « Apple Experience » à Los Angeles, programmée du 27 au 29 janvier. Un timing qui, comme souvent chez la Pomme, ne doit rien au hasard.

Le retour des créateurs sur le devant de la scène

C'est le créateur Petr Mara qui a vendu la mèche en partageant son invitation sur Instagram. Le photographe n'en est pas à son coup d'essai, lui qui avait déjà été invité en septembre dernier pour mettre à l'épreuve l'iPhone 17 Pro.

Apple annonce Creator Studio, un abonnement unique pour toutes ses apps professionnelles, de l’IA et des contenus

Mais cette fois, l'enjeu semble tout autre. Le lancement du nouveau bundle « Creator Studio », qui regroupe les poids lourds logiciels de la maison (Final Cut Pro, Logic Pro et le nouveau venu Pixelmator Pro), est prévu pour le mercredi 28 janvier. Il serait tentant pour Apple de profiter de cette vitrine logicielle pour sortir l'artillerie lourde côté matériel.

Le calendrier s'accélère avant les résultats

Autre indice qui pèse dans la balance : l'annonce des résultats financiers du trimestre, prévue pour le jeudi 29 janvier. Historiquement, Apple n'est pas contre un petit coup d'éclat matériel juste avant de passer au confessionnal devant les investisseurs.

Apple : une fin janvier très chargée en annonces et mises à jour

Après la mise à jour discrète du MacBook Pro 14 pouces d'entrée de gamme en octobre dernier (passé à la puce M5), le terrain est libre pour les versions survitaminées. On attend donc de pied ferme les déclinaisons M5 Pro et M5 Max. Au-delà du gain de puissance brut, ces modèles devraient logiquement hériter de la nouveauté majeure aperçue sur le modèle de base : le stockage PCIe 5.0. De quoi doubler les débits SSD et satisfaire les flux de travail les plus gourmands…