L'A11 Bionic ne relâche pas la pression sur les puces Intel

L'A11 de l'iPhone X contre ses prédécesseurs et face au gros Core i7 d'un MacBook Pro de dernière génération. C'est le plateau réuni par BareFeats qui a lancé quelques apps de benchs sur plusieurs appareils Apple.

L'iPhone X avec son A11 Bionic (2,39 GHz) se mesurait au dernier iPad Pro 12,9" avec son A10X (2,3 GHz), à un iPhone 7 sur A10 (2,3 GHz) et au MacBook Pro 13" Touch Bar de cet été avec l'option Core i7 bicœur à 3,5 GHz et puce graphique Intel Iris Plus Graphics 650.

Processeur principal

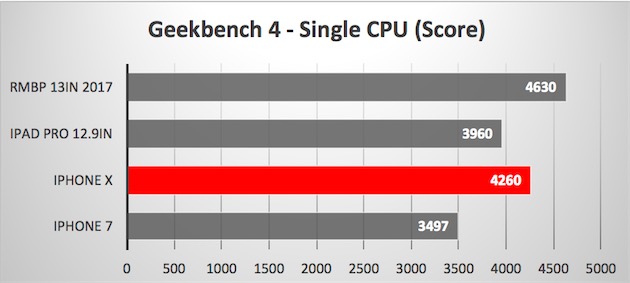

Les deux premiers tests ont mesuré les performances des processeurs en utilisant Geekbench 4. En single core, l'iPhone X se cale à distance égale entre l'iPhone 7 et le MacBook Pro. Le portable de 13" n'est que 8,6 % plus rapide que lui. L'iPhone X dépasse l'iPad Pro dans des proportions similaires (il est 7,5 % plus véloce que la tablette).

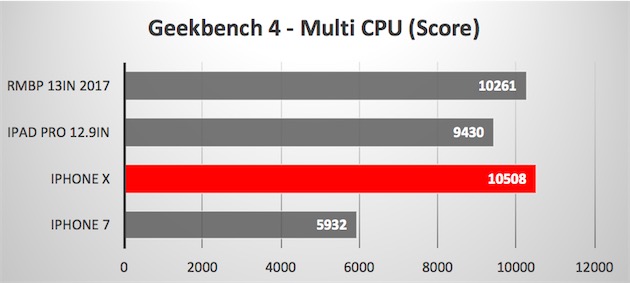

Lorsque tous les cœurs sont sollicités, l'iPhone prend cette fois la tête, de peu (2,4 %). Avec les variations de résultats que peut donner Geekbench d'un test à l'autre, on dira que l'iPhone X et le MacBook Pro 13" font au minimum jeu égal, ce qui n'est pas rien.

L'iPhone X peut utiliser jusqu'à 6 cœurs avec son A11. Le portable pour sa part est un bicoeur mais il gère l'Hyperthreading pour en simuler quatre. Pour compléter ce tableau, avec le Core i7 Quad (8 cœurs en Hyperthreading) à 2,9 GHz du dernier MacBook Pro 15" nous avions obtenu un score de 15 847 à ce test Geekbench. C'est 50% de mieux que l'A11 Bionic. Tout n'est pas foutu au royaume des portables Intel.

Processeur graphique

La lecture des tests des puces graphiques de chacun peut se faire à deux niveaux : les appareils iOS face au portable Intel puis les appareils iOS entre eux, car Apple est maintenant seule maître à bord pour ses processeurs graphiques mobiles depuis les iPhone 8 et X.

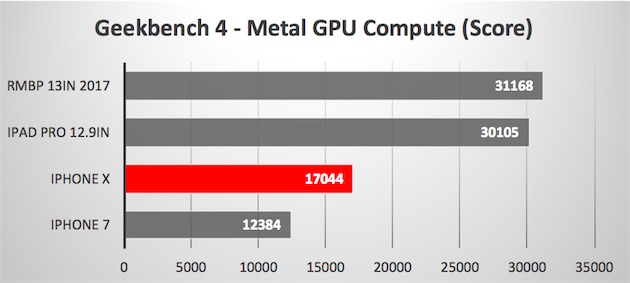

Avec le test Compute de Geekbench qui utilise les API Metal d'Apple, MacBook Pro et iPad sont très loins devant (82% plus rapide dans le meilleur des cas)… et à presque égalité entre eux. L'iPad Pro ne cède pas grand chose au portable, ce qui montre la puissance de cette tablette. Ce test réalise en particulier des opérations de traitement sur des images.

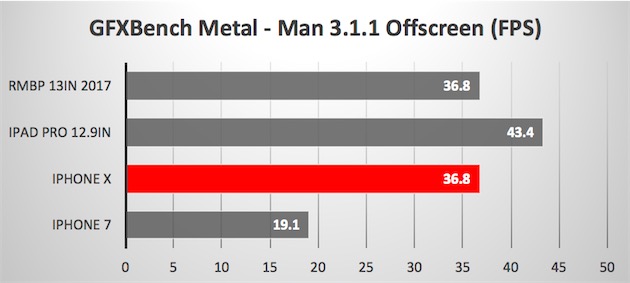

Dans le second test, l'iPhone X est à égalité avec le MacBook Pro (36,8 images/seconde) tandis que l'iPad Pro est en tête (43,4 i/s). Tout ce joli monde ayant des définitions écran différentes, le test a été lancé sur une même base d'affichage de 1440p.

Lorsqu'on regarde uniquement les deux iPhone, on voit que le X a creusé l'écart sur le 7 : il est 37% plus rapide dans l'un des tests, et 92 % plus véloce dans l'autre (36,8 images par seconde au lieu de 19,1 i/s).

On ne s'attendait pas à l'inverse mais cela montre que même en se passant des services d'Imagination Technologies et de ses puces PowerVR utilisées depuis 2007, l'iPhone continue sur sa lancée. Il n'y a ni recul ni pause dans les performances graphiques. Quant aux processeurs d'Intel, ces Ax font toujours office de cailloux dans la chaussure.

Mais avec une puissance pareil dans un si petit appareil, comment ils sont parvenu à refroidir le téléphone?? Quand je vois le mode turbine de mon MBPr avec un Core i7, ça serait interessant de pousser l'iPhone X dans ses retranchement de manière prolongée genre un gros export vidéo 4K ou un gros jeu

@R1x_Fr1x

Il n’y a pas de refroidissement: jouer 10minutes à supermario run sur mon iPhone 7 et je pourrais cuire un œuf dessus ? (j’imagine que l’iPhone X donne des brûlures aux doigts ?!)

@R1x_Fr1x

Les Ax ont une temperature maximale (zone ou le processeur va passer en mode protection et throttler) située vers les 45º...

Les x86 Core ix ont le meme seuil mais a 100º...

Ca veut dire que le maximum de puissance de calcul d'un ARM est atteint a la moitié du dégagement thermique du x86...

Apres il faut comprendre un truc: c'est le meme A11 qui equipe l'iPhone X et l'iPhone 8!

Et le core de l'A11 a peu evolué par rapport a celui de l'A10. Ce qui change entre l'A10 et l'A11 c'est le nombre de core et les coprocesseurs.

L'iPhone 8 et l'iPhone X sont tres similaires en terme de puissance et de fonctions: les 2 seules vraies différences sont l'absence de TouchID et la presence du dispositif Truedepth sur le X. Et ces fonctions sont gerees par des composants dediés et n'ont pas d'impact sur le processeur...

L'A11 est donc tres surdimensionné autant pour l'iPhone 8 que l'iPhone X... pour l'instant.

Car les applications utilisant la VR et donc ARkit vont arriver d'ici un an et vont avoir de tres gros besoin de puissance.

Mais ce seront surtout les iPhone 9 et suivants qui auront besoin de cette puissance.

On peut penser que le changement d'architecture du A11 (plus proche du design de reference d'ARM que ses prédécesseurs avec deux set de core distincts) est une adaptation a cette evolution: un set de core peu puissants et tres economes et un set plus puissants mais qui consomment plus.

Faut aussi penser a un truc: Apple produit un peu moins de 300 millions d'appareils iOS par an et donc commande autant de processeurs Ax a ses fondeurs.

Plus Apple peut faire une grosse commande, plus Apple fait des economies d'echelle et peut negocier les tarifs.

Donc Apple a interet a concevoir le processeur le plus puissant possible pour l'installer dans le maximum d'appareils quitte a le sous exploiter.

En plus cela offre un avantage: les processeurs avec des defauts sont utilisables dans les appareils demandant moins de performances.

On a vu le cas avec les Apple TV par exemple ou le processeur est le meme qu'un iPhone, mais dont un core est désactive...

Le niveau de qualité va en decroissant dans la gamme des appareils iOS, dans l'ordre on a: iPad Pro, dernier iPhone (n), iPhone de generation n-1, iPad grand public, iPhone de generation n-2, Apple TV.

Si Apple sort un jour un Mac sous ARM, alors il sera equipé du meme processeur que l'iPad Pro, et l'iPad Pro aura une frequence inferieure et des core désactivés...

@R1x_Fr1x

L’architecture arm est plus performante sur ce point et peut etre aussi que la gravure est plus fine sur les Ax.

Apres peut etre qu’il y d’autres chose :)

le système d'exploitation n'est pas tout à fait le même non plus.

@françois bayrou

Il sont tres similaires: iOS est un derivé de MacOS a 95%, ou les principales differences sont l'interface (souris vs tactile) et les fonctions de telephonie. Donc pour l'essentiel ils sont similaires pour le processeur.

Par contre l'exploitation de l'architecture ARM est plus souple et offre de meilleures niveaux d'optimisation que le x86 qui est tres fermé et fait beaucoup de cuisine interne sur laquelle l'OS n'a pas de moyens d'action (ni le developpeur)

Apres il y a aussi l'usage des coprocesseurs...

Car que ce soit un x86 ou un Ax, il y a les core d'un coté, qui font des traitements generaliste, mais il y a tous les coprocesseurs integrés qui eux sont specialisés et ultra-optimisés. Par exemple, le decodeur video H265 va utiliser beaucoup moins d'energie et sera beaucoup plus rapide que le meme traitement effectué par les cores x86...

" le decodeur video H265 va utiliser beaucoup moins d'energie et sera beaucoup plus rapide que le meme traitement effectué par les cores x86"

...d'ou l'intérêt de comparer un export vidéo 4K entre un ipad et un x86 avec un autre codec que H265.

Et là on risque d'avoir d'autres chiffres, et un écart bien plus important.

@RedMak

«L’architecture arm est plus performante sur ce point et peut etre aussi que la gravure est plus fine sur les Ax.»

Oui et non.

Oui l'efficacité energetique d'un ARM est tres superieure a celle des x86 ce qui explique tout.

Non la finesse de gravure n'a pas un impact significatif, pour 2 raisons:

- en dessous de 32nm les gains sont marginaux en terme de degagement thermique

- la finesse de gravure prise en compte est celle minimale alors qu'en realité la majeur partie du die est gravé beaucoup moins fin

La production thermique vient de lois physiques universelles et incontournables. En tres gros (y en a qui vont hurler, desolé) plus un courrant electrique doit traverser un grand nombre d'atomes plus ça produit de la chaleur. Quand on parle de diminuer le nombre d'atomes de plusieurs milliers l'impact est important. Mais depuis le passage sous les 22nm on compte les atomes en moins a l'unité... l'impact est donc negligeable.

A cela se rajoute qu'il faut depenser de l'energie pour compenser les erreurs qui sont produites par les effets physiques bizarres a ces niveau (dont les fameux effets quantiques).

Quant a l'homogeneite de la finesse de gravure... un processeur c'est un composant monstrueusement complexe qui est tout sauf uniforme. Plusieurs architectures et differents niveaux d'assemblages cohabitent: plusieurs niveaux de gravures sont utilisés.

Et les fondeurs ne comptent que celle minimale, meme si celle-ci représente que 5%...

Nvidia a demontré avec ses GPU de generation precedente qu'en restant a la meme finesse de gravure il ont reussi a doubler la puissance tout en ameliorant l'efficacité energetique. Et c'etait de la gravure a 28nm!!

Donc ce qui fait toute la difference aujourd'hui c'est l'architecture.

Il faut se rappeller que le core x86 stagne depuis 10 ans. Intel n'a pas reussi a en ameliorer ni la puissance, ni l'efficacité energetique. La seule chose qu'Intel a fait c'est optimiser la gestion de l'alimentation (eteindre tout ce qui est possible le plus vite et le plus longtemps possible) et optimiser l’ordonnancement histoire d'eliminer les cycles vides. Et pus il y a le fameux turbo, qui est un biais commercial pour ne pas compter la depense reelle de fonctionnement: Intel donne une consommation, production thermique et un TDP hors turbo...

Le TDP reel d'un pauvre processeur soufreteux comme le Core-M (Core i5/i7 xxxY) est de proche de watt...

Les ARM eux depuis plus de 10 ans augmentent leurs puissance a chaque generation (en moyenne un doublement) tout en ameliorant leurs efficacité energetique.

Le TDP reel d'un monstre comme le Snapdragon 835 (tres proche de l'A11) est de 4 de watt au maximum...

Non le TDP donné par Intel n'est pas hors turbo. Il fait justement partie des éléments utilisés pour déterminer le boost maximum. Et généralement Intel est un bon élève : http://www.hardware.fr/articles/970-4/consommation-efficacite-energetique.html , bien meilleur qu'AMD.

Pour le cas du Core-M, il ne faut pas confondre SDP et TDP.

@R1x_Fr1x

"Mais avec une puissance pareil dans un si petit appareil, comment ils sont parvenu à refroidir le téléphone??"

C'est tout le problème.

J'ai lancé trois fois AnTuTu sur mon X, et la troisième fois AnTuTu me dit de laisser le X refroidir avant de relancer le test. Et effectivement ça chauffait pas mal

C'est ce qui fait la différence encore entre cet ARM et les core i

Certes le bionic est extremement performant, mais il ne pourra par perdurer autant que les cores i. De la même manière entre les core i et les processeurs de la famille Xeon.

@XiliX

Merci pour le retour. Mais dans ce cas, si son architecture ARM le limitera sur la durée et si son boost est bridé, quel but d'avoir autant de puissance? Seulement pour une grosse demande ponctuelle? Dans ce cas, est-ce que ce super processeur n'est tout simplement pas surdimensionné pour un téléphone notamment en terme de dissipation thermique?

Je comprends vraiment pas l'avantage d'une telle puissance si

1/ elle est bridée

2/ elle ne permet pas un usage prolongé

@R1x_Fr1x

"... quel but d'avoir autant de puissance? Seulement pour une grosse demande ponctuelle?"

Oui je pense que pour le moment c'est pour des besoins ponctuels comme pour la phase de reconnaissance faciale. Autant, et en toute honnêteté, que le A11 est surdimensionné pour le 8, autant pour le X non. Le X a grandement besoin d'une grosse puissance pour pouvoir modéliser le visage rapidement pour ensuite comparer avec la base.

Donc oui dans ce cas le besoin reste ponctuel.

Et ce n'est pas à cause de l'architecture ARM. Il ne faut pas oublier que ARM, initialement est un acronyme d'Acorn Risc Machine avant de devenir Advanced Risc Machine.

Une superbe machine Risc des années 80. Donc dès le départ déjà la conception permettrait de tourner sur des ordinateurs.

Dans le cas de A11, je pense et c'est mon avis personnel ne travaillant pas dans l'équipe Apple, qu'il est capable de travailler en "full power" que sur une courte durée. D'une part ça bouffe de l'énergie (batterie), d'autre part la dissipation thermique est trop important pour un smarphone. En revanche, il est bien capable de travailler plus que correctement sur une longue durée. Pour les jeux par exemple.

S'il doit se retrouver actuellement dans un portable, je pense que le MBA 11" est adapté pour le A11. Pas besoin d'un processeur super performant pur une utilisation basique.

"1/ elle est bridée"

Donc non la puissance n'est pas bridée, il faut juste savoir l'utiliser que lorsque c'est nécessaire. De plus en plus d'application utilisent maintenant l'identification par FaceID, donc la puissance est là disponible en permanence. Il n'y a donc pas de bridage de puissance.

"2/ elle ne permet pas un usage prolongé"

Ce n'est pas fait pour. D'une part l'architecture du smartphone elle même qui ne permet pas d'installer un "dissipateur thermique", d'autre part, c'est un mobile (smartphone/tablette). On ne va pas lui demander des calculs monstrueux non plus. D'ailleurs c'est pareil pour les ordinateurs de bureau dont certains sont complètement sur-dimensionnés.

Je persiste à dire que ces deux CPU ne sont pas comparables et tournent dans des environnements bien différents, aussi expliquer qu'un A11 est aussi puisant qu'un core i5 me fait toujours doucement marrer

Maintenant pour en revenir sur le point que vous discutez, à savoir les boost de puissance ponctuels et leurs intérêts, il est pourtant simple de voir que l'on utilise son iphone, et, j'ai envie de dire, son ordinateur pour une utilisation ultra-portable, en ne faisant que très ponctuellement des actions nécessitant de la puissance

Que l'on soit sur un iphone en retouchant une photo (correction colorimétrique, application de filtres, retouches basiques) ou en demandant à l'iPhone de le faire (mode portrait : détection automatique des contours d'une personne dans une photo + application d'un filtre Lens Blur sur l'arrière plan), ou même que l'on passe simplement d'une app à l'autre (gestion des fentres, animation de l'interface), etc, etc, tout cela nécessite beaucoup de puissance mais sur une durée très limitée

Si l'on en revient aux ordinateurs, c'est ce qui permet à un Macbook 12" de s'afficher aussi puissant qu'un Macbook Pro core i5 ou qu'un Macbook Air (voir plus, avec son SSD bien plsu rapide), car la puissance sur la longue durée, cela s'appelle bien souvent des "exports vidéo" ou du "rendu 3D" ou tout autre calcul nécessitant puissance dans le temps ... et que l'on ne fait pas sur son téléphone ou sur son ultra-portable (ou on assume, et on patiente un peu plus, mais on peut sortir le taf alors qu'on est loin de sa machine principale)

Les gars de chez Mac4Ever nous expliquent et ré-expliquent que le Macbook throttle dès que l'on lance les benchs 4 fois de suite ou que l'on lance un gros rendu vidéo, et donc que son boost puissance est un leurre, alors qu'en fait, ils font une utilisation de la machine qui n'est absolument pas prévue pour.

Et dans un cadre d'utilisation "normale", l'iPhone X ou le 8, ou le Macbook 12" monte en puissance ponctuellement, au besoin, et assure un niveau de fluidité et de confort excellent

C'est tout sauf inutile, et il n'y a rien de bridé

Prenez votre Mac, lancez le moniteur d'activité, et constatez ... le CPU passe 90% de sa journée à se tourner les pouces. Avoir une débauche de puissance qui tient dans le temps ne sert plus à rien, les CPU même entrée de gamme sont tellement puissants qu'ils sont le plus souvent inutilisés

L'approche d'un CPU fanless qui booste ponctuellement est très maligne, et permet de se passer de ces putains de ventilos

Bien sur ma station de travail i7 / GTX 970 est ultra ventilée et ça tourne en permanance, mais tout le monde n'utilise pas une station de travail avec Première, After, C4D, Blender et Cie

@pocketalex

"ma station de travail i7 / GTX 970"

Sous quelle os?

Sous MacOS, c'est un hackintosh

Mais il commence à dater ... 2012

Alors j'ai pu changer la CG qui était une Geforce 640 (j'ai été un peu radin lors du montage), ajouter des SSD Sata à foison, ça c'est le bon coté du hackintosh, mais par contre j'ai privilégié le design à l'usage, du coup je suis parti sur du mini-ITX, et la carte-mère de l'époque ne gère pas plus de 16Go de RAM, c'est devenu une véritable goulet d'étranglement, j'ai besoin de 64Go pour ce que je fais.

Bon, le CPU commence aussi à accuser l'âge, il fait 12000 à GeekBench4 là ou un i7 7700K fait 19000, mais ça n'empêche pas de bosser, il balance encore assez.

Mais ça plus ça plus ça, plus des petits soucis qui n'existaient pas et me tombent dessus de temps en temps (décalage de l'heure, machine qui rebut soudainement, ...), bref il est temps de la changer

J'arrête l'aventure du hackintosh et je vais repasser sur un vrai Mac, depuis qu'Apple à mis à jour les iMacs ça commence à tenir un peu la route

Je n'aurai pas la CG la plus puissante du monde, je le sais. Mais elle offre assez de puissance pour seconder mes apps. En revanche, c'est sympa de parler de puissance GPU mais dans mon quotidien, le principal goulet d'étranglement c'est les datas car je gère des fichiers de plus en plus lourds, que ce soit des vidéos (4K) ou des photos (Raw 40Mpx) et avec l'iMac, je disposerai d'un port TB3 bien géré, auquel sera relié un NAS/DAS TB3 qui stockera les rushes projet.

Le TB3 n'est pas, à ce jour, bien géré par les hackintosh, et je n'ai aucunement envie de me lancer dans une aventure douteuse avec une machine montée à la main

J'ai aussi réfléchi à passer sur PC, surtout pour mes applications, mais au final et après discussion avec de nombreuses personnes (photographes, vidéastes, motion designer) qui ont franchi ce pas, le bilan est tout sauf rose, et le temps gagné parfois avec un rendu plus rapide ou des preview qui laguent moins est perdu avec l'ergonomie de la machine et de nombreux soucis techniques, exactement ce que j'ai connu avant de faire switcher toute ma boite sur Mac

@pocketalex

"Je persiste à dire que ces deux CPU ne sont pas comparables et tournent dans des environnements bien différents, aussi expliquer qu'un A11 est aussi puisant qu'un core i5 me fait toujours doucement marrer"

Perso je trouve que c'est tout à fait possible de comparer les environnements différents.

Dans son environnement, ses optimisations, on peut comparer sans problèmes les processeurs dans son OS, son application. A condition bien sûr que l'application soit optimisée pour son environnement.

Comparer donc le résultat d'un bench entre

- iOS/Ax

- Android/SnapDragon (ou autres)

- i5 (ou autres)/Windows

* i5 (ou autres)/OSX

On fait bien un bench pour comparer la performance d'un i5 vs i7 vs Xeon ?

Or on sait pertinemment que ces processeurs sont très différents dans leur architecture.

Ce fût une époque on comparait aussi les Atom vs Arms

Donc on peut tout comparer, même s'il faut prendre du recul pour analyser le résultat.

Peut-on comparer A11/iOS/Geekbench vs Exynos/Android/Geekbench vs Snapdragon/Android/Geekbench vs i5/Windows/Geekbench - i7/Windows/Geekbench ?

Pour moi la réponse et oui. On peut conclure que Geekbench tourne très bien avec tel processeur et tel OS...

Ce n'est pas comme si on comparait des applications différentes avec des processeurs différents et des OS différents. Le point commun ici est l'application

@XiliX

«Perso je trouve que c'est tout à fait possible de comparer les environnements différents.»

Oui, ce qu'il faut comparer c'est soit la puissance de calcul brute, soit l'efficacité d'usage.

Niveau de puissance de calcul brute, c'est tres simple, y a des bench qui font cela de maniere efficace, faut il encore les laisser tourner assez longtemp parce qu'il faut aussi ealuer la puissance de calcul selon l'efficacité energetique: si un proc monte a fond mais ne tient pas 5 minutes il sera moins performant qu'un proc qui monte a la moitie de la puissance mais tient des heures a ce regime. On a le cas avec le Core-M d'Intel qui et le champion du monde de l'esbrouffe et de la non activité...

L'efficacité d'usage, c'est pas un bench, c'est d'evaluer un usage en condition reelle avec des softs de production. La c'est tout autre chose et c'est tres specifique.

Ceci dit, il faut se rappeler d'une chose essentielle: les Ax d'Apple comme les Sampdragon et autres sont conçus pour animer des smartphone, ont un TDP de 4 watt reel au maximum et un seuil de temperature max de 45º...

Un x86, meme souffreteux comme le Core-M c'est un TDP effectif de 28watt, et un seuil de temperature max de 100º...

Le jour ou Apple decidera de faire des ARM pour desktop, je sais pas a quoi chez Intel on pourra les comparer, mais ce sera bien plus puissant que des Core i7...

@C1rc3@0rc

Yep... tout à fait d'accord

@XiiX

Je ne suis pas contre la comparaison entre un A11 et un x86, c'est pas le comparatif en soi qui me pose souci, c'est les conclusions qu'on en tire

Lancer un export 4K sur iPad et un export 4K sur Mac, et constater que les résultat sont similaires incite à conclure "l'A11 est aussi puissant que le x86"

Dans la réalité, l'A11 à un copro dédié à l'accélération matérielle pour la gestion du codec H265

Or dans la vie réelle, on bosse avec de nombreux formats et de nombreux codec et même de nombreuses dimensions vidéo, et pas juste du 4K H265, et bien évidemment, si l'on sort du cadre spécifique ou l'iPad dispose d'une accélération matérielle, je suis pas sur que les chiffres soient aussi flatteurs pour l'A11

@pocketalex

En fait c'est la raison pour laquelle la comparaison entre A11 et i5 ou i7 se fait avec les modèles i5/i7 U et non pas avec les gros procos intel qui restent bien sûr loin devant le A11

C'est pour ça, en partant de cette constatation, le A11 peut très bien trouver sa place dans le MBA 11 voire MBA 13. Dont l'utilisation reste très basique, à savoir de la bureautique avec de temps à autres de l'encodage.

@XiiX

" le A11 peut très bien trouver sa place dans le MBA 11 voire MBA 13"

Dire ça, c'est considérer que les benchs te font conclure que les 2 CPU (l'A11 et le i5u) ont un même niveau de performances, et c'est pile sur ce point que je diffère de ce que tu penses

L'A11, c'est un vélo cross électrique ultra performant. Le i5u, c'est une ferrari. Et on fait la course dans un champ de patates, mais qui, à l'arrivée ex-aequo, va se permettre d'affirmer que le vélo-cross est tout le temps aussi rapide qu'une Ferrari ???

C'est tout le but de mon propos, entre un CPU de téléphone ultra rapide et ultra optimisé pour de nombreuses taches spécifiques (décodage d'un codec vidéo, etc) et un CPU d'ordinateur capable de prendre énormément de choses en charge avec assez de puissance pour traiter tout cela confortablement, on peut jouer aux comparatifs, mais gare aux conclusions fantaisistes

On va arriver aux laptops sous ARM, je dis pas le contraire, et il va bientôt sortir des PC sous Windows qui vont jouer ce jeu

Mais cela implique une double compilation des Apps, pour éviter de passer par la case émulation, et gérer ça c'est vraiment la mouise, on est déjà passé par la à une époque.

Ce qui est sur, c'est que c'est pas demain que l'ensemble de la gamme sera sous ARM, donc il faudra co-exister deux OS pour deux types de machines différentes, et les développeurs devront doubler leurs Apps

@pocketalex

"L'A11, c'est un vélo cross électrique ultra performant. Le i5u, c'est une ferrari. "

Tu spécules ou tu es sur de toi dans tes comparatifs?

Ça fait plusieurs posts où tu dis que l’A11 est juste bon dans les taches où il est optimisé mais que pour le reste il se ferait bouffer………Mais ça t’en sais rien du tout.

"Ça fait plusieurs posts où tu dis que l’A11 est juste bon dans les taches où il est optimisé mais que pour le reste il se ferait bouffer"

Ce n'est pas exactement ce que j'ai dis

Juste que le comparatif "test geekbench" ou "export H65" avec un core-i ne permet pas de déduire que les deux CPU sont identiques en puissance et donc que si l'on faisait tourner un MacOS compilé en ARM avec des applis compilées en ARM on aurait la même chose qu'avec un core i

ça ne veut pas dire que l'A11 est une tôle. C'est un excellent processeur de téléphone.

@R1x_Fr1x

Plus le proc est puissant, moins une opération donnée durera longtemps, moins cela mangera la batterie. Bon, c'est un peu exagéré, mais l'idée est là

@ Lonesome Boy

Ce n'est pas exagéré, c'est exactement ca l'idée.

@Stardustxxx

Dans la vrai vie, ce n'est pas aussi simple, malheureusement. Un processeur 2 fois plus puissant ne va pas diviser par 2 la consommation de batterie pour effectuer la même tâche. Je doute même fortement que la consommation électrique du processeur uniquement soit divisée par 2.

@ Lonesome Boy

L'équation est plus compliqué que cela, car il n'y a pas que ton cpu qui consomme ta batterie.

Plus vite ton cpu a fini, plus rapidement tu peux "éteindre" les autres composants.

il a été scientifiquement prouvé que si l'on coure sous la pluie on est moins mouillé au final que si l'on fait le même trajet en marchant

A méditer

Faut en effet pas confondre temps d'usage et consommation electrique. Si une operation demande 2 fois moins de temps mais demande 2 fois plus d'energie ça consomme autant, mais ça vide la batterie plus vite...

Il faut faire tres attention au processeurs a "turbo", le mode turbo fait exploser la consommation et vide la batterie avec la meme intensité... on a un exemple d'horreur avec le Core-M, il a ete conçu pour animer un smartphone, mais consomme trop pour cela...

@Lonesome Boy

"Plus le proc est puissant, moins une opération donnée durera longtemps, moins cela mangera la batterie. Bon, c'est un peu exagéré, mais l'idée est là"

Je suis moins convaincu.

Est-ce que rouler à 200km/h pour faire 200 km consomme moins que rouler à 110km/h pour faire la même distance ?

Pas évident

Comparer les perfs en calcul d'un RISC avec un CISC c'est rigolo mais ça sert pas à grand chose dans le fond.

@adamB

Exactement : cela permet de montrer qu un processeur RISC sur une architecture/OS fermée et dédiée et largement plus efficiente qu un processeur généraliste (x86) sur un OS généraliste (Mac OS, mais Windows c est pareil).

Rapport watt/ points geekbench qui se différencie d un rapport 10?

@adamB

Les processeurs modernes mélangent sans problèmes les jeux d'instructions RISC/CISC. Il n'existe plus comme avant des processeurs spécifiquement RISC ou CISC.

D'ailleurs, un processeur purement RISC dans un ordinateur bureautique ou smartphone n'a aucun sens. Il perdrait alors tout son intérêt, car pour une utilisation de tous les jours, il y aurait trop d'appels sur "les branchements conditionnels" que de calculs. Or les RISC sont plus handicapés dans ce domaine que les CISC

Je ne m'attendais pas à lire CISC en 2017 :-)

Sachant qu'il est fort probable qu'Apple bride, voire supprime la fonction turboboost des processeurs Intel, de façon à,ce que les Macintosh ne se transforment pas en barcecue dès qu'ils arrivent à quasiment 5ghz.

Un processeur Intel non bridé viole n'importe quel Ax. On va nous faire croire qu'une petite puce de téléphone portable non refroidie génère autant de puissance qu'un gros CPU sur lequel on est obligé de mettre un ventirad pour pas que ça surchauffe?

Allons, allons ....

"Geekbench", voilà qui porte bien son nom.

@Issou la chancla

"Sachant qu'il est fort probable qu'Apple bride, voire supprime la fonction turboboost des processeurs Intel"

Ils indiquent dans l'Apple Store, à la commande, les fréquences de turbo boots des CPU, alors si c'est pour les supprimer ensuite ... j'y crois pas trop

Apple ne bride rien du tout, les CPUs se brident tout seul si leur température est excessive, pourquoi s'embêter ?

Là ou Apple bride, c'est quand ils mettent dans une machine desktop un CPU de laptop, mais ce dernier n'est pas bridé, juste l'opération en soit est un bridage, un CPU avec TDP de 45W ne rivalise pas avec un CPU de 90W. Bon après ils font ça dans les machines bureautique, ça peut avoir du sens...

Sur le fond, sur le comparatif entre une puce de téléphone/tablette optimisée pour certaines taches, et une puce de laptop voir de desktop, voir de station de travail ... je suis d'accord avec toi

C’est marrant cette façons de voir ... imaginant que la CPu fasse tout :-).... Montez un moteur de formule 1 sur une 2cv .... Ca ne tiendra pas la route et vous n’en tirerez pas grand chose... Un peu comme un intel monté sur un CM à 45€.... Et l’iPhone 8 il s’en sort comment car moins cher avec « presque » la même CPu.... On essayerait pas de justifier l’injustifiable ? ;-)

Incroyable la puissance de l'iPad, je me demande ce qu'elle vaut face à la Nintendo switch. Dommage que les développeurs en profite pas.

Mais alors pourquoi dans les speed tests il fait jeu égale voir moins bien que les autres smartphones de la concurrence ????

Il devrait les atomiser pourtant ?

Sa ressemble pas à Apple ce côté infiniment devant sur le papier ou dans les tests mais pareille ou moins bon en usage ?

Bah si Intel est foutu. Hilarant de comparer une puce de téléphone avec une puce de bureau. Vu ce qu’on voit ici, si demain Apple fait une puce de Mac, plus grosse, plus haute fréquence, 8 cœurs, et avec un plus gros TDP, elle va juste exploser n’importe quelle autre puce Intel sur terre.

Je comprends d’ailleurs pas pourquoi ils ne le font pas encore

@ wolf33d

"Je comprends d’ailleurs pas pourquoi ils ne le font pas encore"

Parce que c'est pas aussi évident que tu le dis.

Un CPU est designé pour une utilisation, ca implique des tradeoffs, les tradeoffs que tu doit faire pour être sur mobile ne sont pas les même que pour le desktop, cela implique que ce qui est efficace sur mobile, le ne sera probablement pas sur desktop.

Bref, regardes les CPU servers ARM 64 bits, pour le moment ca consomme plus et c'est moins rapide qu'un équivalent x86 Intel.

De plus Geekbench inclus des test de crypto qui sont nettement plus rapide sur ARM que sur x86, ce qui biaise le résultat.

J'hésite quand je vois ce genre d'article, est-ce :

i) un publi-reportage destiné à récupérer une manne de la part d'Apple

ii) un manque de connaissance patent et caractérisé sur le fonctionnement et les architectures des microprocesseurs

...

Je ne dis pas que telle ou telle puce est mieux/moins bien positionnée, mais juste qu'il faut analyser et comprendre le sens des comparaisons que l'on fait !

@ Zara2stra

Tu peux rajouter : iii ) promotion de Geekbench

C'est bien de baser ses conclusions sur un seul "benchmark"!!

@Stardustxxx

Effectivement on ne parle que de Geekbench ici.

Pourtant le résulta est pareil avec les autre bench existants sur ces plateformes

@ XiliX

Quel autres benchmarks ?

Bref tout cela pour rappeler que Windows va aussi passer sous arm, et garder les cpu Intel encore au dessus.

Dans tous les cas, ça sent la fin ou du moins la reconversion pour Intel a un moment où à un autre....

Chacun connaît son moment de gloire et fini par faire parti des meuble.

Ça finira par arrive à Apple....

En tout cas Arm chez Apple ça a l'air prometteur et au jeu de l'optimisation qu'il maîtrise déjà bien entre matériel (processeur maison, puce graphique maison ?...) le logiciel et une poignée d'appareils.... ça promet face à Windows et les dizaines de fabriquants.

Difficile de nommer l'A11 «A11 Bionic» alors que les testes ne porte pas sur l'utilisation spécifique du copro'Bionic qui a pour but de réaliser des calculs très rapides sur l'acquisition de données (biométrique) !!!

Encore faudrait-il avoir des infos sur la puissance de ce coprocesseur afin de mettre en place un teste pertinent sur les calculs qu'il réalise pour commencer la comparaison.

Perso, ce genre de test je les trouve ... inutiles... Je ne fais jamais tourner geekbench pour du travail...

Par contre avoir un comparatif réel ce serait mieux. Genre combien de temps prend un encodage ProRes de 1 heure à partir d'un flux AVCHD. Combien de temps pour le rendu avec garage band entre deux projets exactement semblables etc etc... La on aurait une comparaison réelle et de fait, on pourrait vraiment comparer les deux architectures... La on est plus dans des chiffres théoriques, mais pratiquement, un mbp core i7 se fait rattraper sur un gros encodage ou pas?

Possible à la rédaction de faire vite fait un petit test comparatif en usage réel?

@debione

un gros +1

moi ça me fait marrer les comparatifs d'exports vidéo entre l'iPad Pro et le Mac, sachant que sur iPad Pro, iMovie va te faire un export en H265 et que son CPU est optimisé pour accélérer matérielement ce codec, d'ou des résultats tout à fait honorables

En face, tu as un core i5 ou un core i7 qui va prendre en charge tout type de format, tout type de codec, et non juste un seul

Pages